Имея

прямую регрессии, необходимо оценить

насколько сильно точки исходных данных

отклоняются от прямой регрессии. Можно

выполнить оценку разброса, аналогичную

стандартному отклонению выборки. Этот

показатель, называемый стандартной

ошибкой оценки, демонстрирует величину

отклонения точек исходных данных от

прямой регрессии в направлении оси Y.

Стандартная ошибка оценки ()

вычисляется по следующей формуле.

Стандартная

ошибка оценки измеряет степень отличия

реальных значений Y от оцененной величины.

Для сравнительно больших выборок следует

ожидать, что около 67% разностей по модулю

не будет превышать

и около 95% модулей разностей будет не

больше 2.

Стандартная

ошибка оценки подобна стандартному

отклонению. Ее можно использовать для

оценки стандартного отклонения

совокупности. Фактически

оценивает стандартное отклонение

слагаемого ошибки

в статистической модели простой линейной

регрессии. Другими словами,

оценивает общее стандартное отклонение

нормального распределения значений Y,

имеющих математические ожидания

для каждого X.

Малая

стандартная ошибка оценки, полученная

при регрессионном анализе, свидетельствует,

что все точки данных находятся очень

близко к прямой регрессии. Если стандартная

ошибка оценки велика, точки данных могут

значительно удаляться от прямой.

2.3 Прогнозирование величины y

Регрессионную

прямую можно использовать для оценки

величины переменной Y

при данных значениях переменной X. Чтобы

получить точечный прогноз, или предсказание

для данного значения X, просто вычисляется

значение найденной функции регрессии

в точке X.

Конечно

реальные значения величины Y,

соответствующие рассматриваемым

значениям величины X, к сожалению, не

лежат в точности на регрессионной

прямой. Фактически они разбросаны

относительно прямой в соответствии с

величиной

.

Более того, выборочная регрессионная

прямая является оценкой регрессионной

прямой генеральной совокупности,

основанной на выборке из определенных

пар данных. Другая случайная выборка

даст иную выборочную прямую регрессии;

это аналогично ситуации, когда различные

выборки из одной и той же генеральной

совокупности дают различные значения

выборочного среднего.

Есть

два источника неопределенности в

точечном прогнозе, использующем уравнение

регрессии.

-

Неопределенность,

обусловленная отклонением точек данных

от выборочной прямой регрессии. -

Неопределенность,

обусловленная отклонением выборочной

прямой регрессии от регрессионной

прямой генеральной совокупности.

Интервальный

прогноз значений переменной Y

можно построить так, что при этом будут

учтены оба источника неопределенности.

Стандартная

ошибка прогноза

дает меру вариативности предсказанного

значения Y

около истинной величины Y

для данного значения X.

Стандартная ошибка прогноза равна:

Стандартная

ошибка прогноза зависит от значения X,

для которого прогнозируется величина

Y.

минимально, когда

,

поскольку тогда числитель в третьем

слагаемом под корнем в уравнении будет

0. При прочих неизменных величинах

большему отличию соответствует большее

значение стандартной ошибки прогноза.

Если

статистическая модель простой линейной

регрессии соответствует действительности,

границы интервала прогноза величины Y

равны:

где

— квантиль распределения Стьюдента с

n-2 степенями свободы ().

Если выборка велика (),

этот квантиль можно заменить соответствующим

квантилем нормального распределения.

Например, для большой выборки 95%-ный

интервал прогноза задается следующими

значениями:

Завершим

раздел обзором предположений, положенных

в основу статистической модели линейной

регрессии.

-

Для

заданного значения X генеральная

совокупность значений Y имеет нормальное

распределение относительно регрессионной

прямой совокупности. На практике

приемлемые результаты получаются

и

тогда, когда значения Y имеют

нормальное распределение лишь

приблизительно. -

Разброс

генеральной совокупности точек данных

относительно регрессионной прямой

совокупности остается постоянным всюду

вдоль этой прямой. Иными словами, при

возрастании значений X в точках данных

дисперсия генеральной совокупности

не увеличивается и не уменьшается.

Нарушение этого предположения называется

гетероскедастичностью. -

Слагаемые

ошибок

независимы между собой. Это предположение

определяет случайность выборки точек

Х-Y.

Если точки данных X-Y

записывались в течение некоторого

времени, данное предположение часто

нарушается. Вместо независимых данных,

такие последовательные наблюдения

будут давать серийно коррелированные

значения. -

В

генеральной совокупности существует

линейная зависимость между X и Y.

По аналогии с простой линейной регрессией

может рассматриваться и нелинейная

зависимость между X и У. Некоторые такие

случаи будут обсуждаться ниже.

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

Что такое стандартная ошибка оценки? (Определение и пример)

17 авг. 2022 г.

читать 3 мин

Стандартная ошибка оценки — это способ измерения точности прогнозов, сделанных регрессионной моделью.

Часто обозначаемый σ est , он рассчитывается как:

σ est = √ Σ(y – ŷ) 2 /n

куда:

- y: наблюдаемое значение

- ŷ: Прогнозируемое значение

- n: общее количество наблюдений

Стандартная ошибка оценки дает нам представление о том, насколько хорошо регрессионная модель соответствует набору данных. Особенно:

- Чем меньше значение, тем лучше соответствие.

- Чем больше значение, тем хуже соответствие.

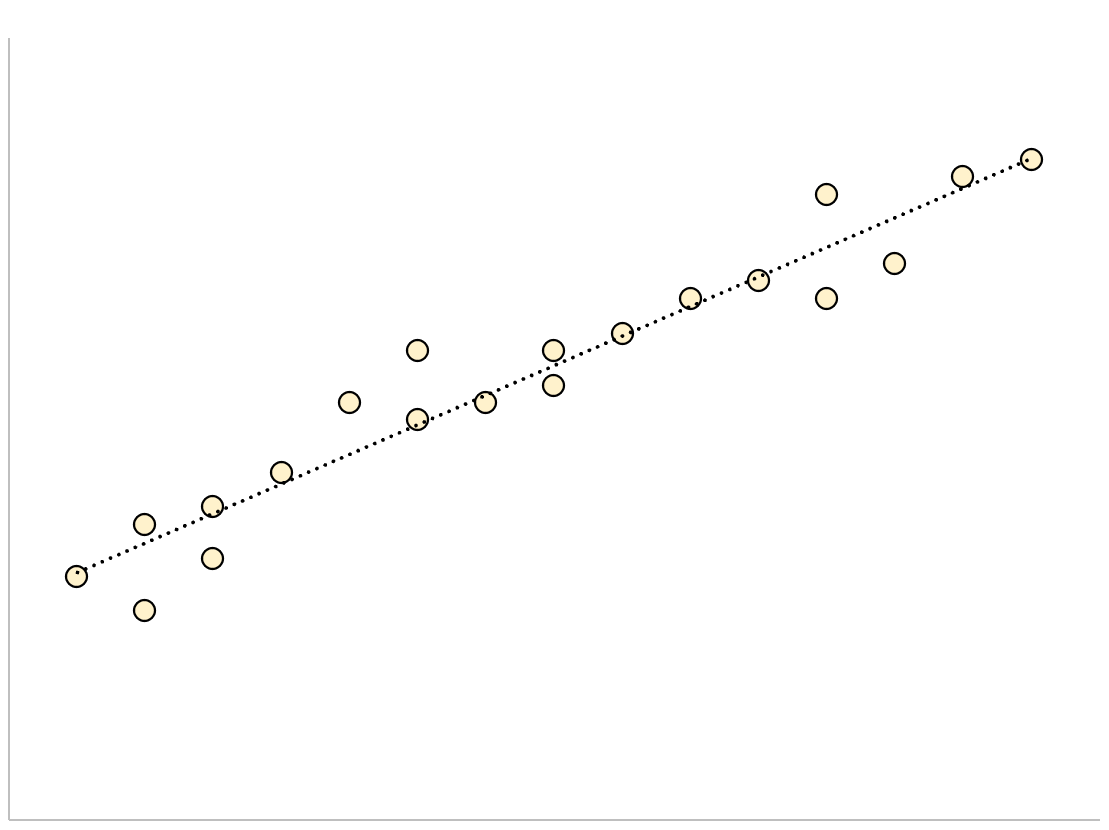

Для регрессионной модели с небольшой стандартной ошибкой оценки точки данных будут плотно сгруппированы вокруг предполагаемой линии регрессии:

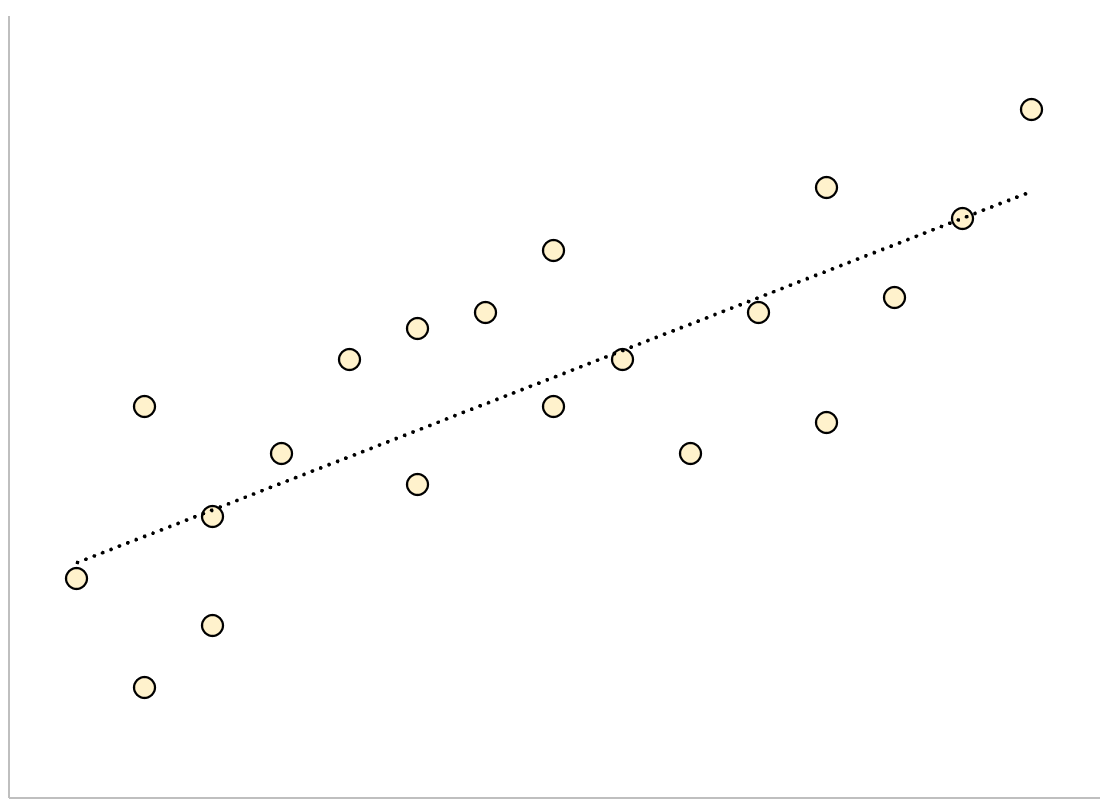

И наоборот, для регрессионной модели с большой стандартной ошибкой оценки точки данных будут более свободно разбросаны по линии регрессии:

В следующем примере показано, как рассчитать и интерпретировать стандартную ошибку оценки для регрессионной модели в Excel.

Пример: стандартная ошибка оценки в Excel

Используйте следующие шаги, чтобы вычислить стандартную ошибку оценки для регрессионной модели в Excel.

Шаг 1: введите данные

Сначала введите значения для набора данных:

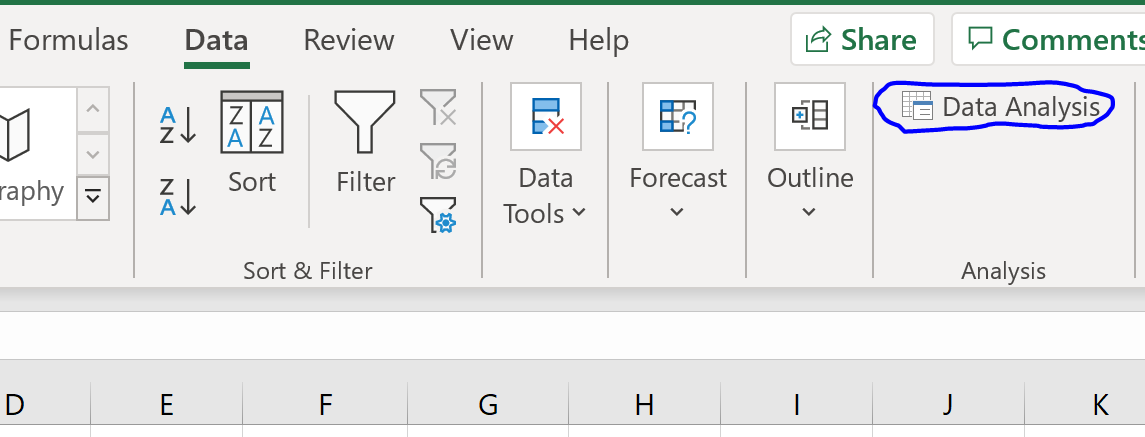

Шаг 2: выполните линейную регрессию

Затем щелкните вкладку « Данные » на верхней ленте. Затем выберите параметр « Анализ данных» в группе « Анализ ».

Если вы не видите эту опцию, вам нужно сначала загрузить пакет инструментов анализа .

В появившемся новом окне нажмите « Регрессия », а затем нажмите « ОК ».

В появившемся новом окне заполните следующую информацию:

Как только вы нажмете OK , появится вывод регрессии:

Мы можем использовать коэффициенты из таблицы регрессии для построения оценочного уравнения регрессии:

ŷ = 13,367 + 1,693 (х)

И мы видим, что стандартная ошибка оценки для этой регрессионной модели оказывается равной 6,006.Проще говоря, это говорит нам о том, что средняя точка данных отклоняется от линии регрессии на 6,006 единицы.

Мы можем использовать оценочное уравнение регрессии и стандартную ошибку оценки, чтобы построить 95% доверительный интервал для прогнозируемого значения определенной точки данных.

Например, предположим, что x равно 10. Используя оценочное уравнение регрессии, мы можем предсказать, что y будет равно:

ŷ = 13,367 + 1,693 * (10) = 30,297

И мы можем получить 95% доверительный интервал для этой оценки, используя следующую формулу:

- 95% ДИ = [ŷ – 1,96*σ расч ., ŷ + 1,96*σ расч .]

Для нашего примера доверительный интервал 95% будет рассчитываться как:

- 95% ДИ = [ŷ – 1,96*σ расч ., ŷ + 1,96*σ расч .]

- 95% ДИ = [30,297 – 1,96*6,006, 30,297 + 1,96*6,006]

- 95% ДИ = [18,525, 42,069]

Дополнительные ресурсы

Как выполнить простую линейную регрессию в Excel

Как выполнить множественную линейную регрессию в Excel

Как создать остаточный график в Excel

Загрузить PDF

Загрузить PDF

Стандартная ошибка оценки служит для того, чтобы выяснить, как линия регрессии соответствует набору данных. Если у вас есть набор данных, полученных в результате измерения, эксперимента, опроса или из другого источника, создайте линию регрессии, чтобы оценить дополнительные данные. Стандартная ошибка оценки характеризует, насколько верна линия регрессии.

-

1

Создайте таблицу с данными. Таблица должна состоять из пяти столбцов, и призвана облегчить вашу работу с данными. Чтобы вычислить стандартную ошибку оценки, понадобятся пять величин. Поэтому разделите таблицу на пять столбцов. Обозначьте эти столбцы так:[1]

-

2

Введите данные в таблицу. Когда вы проведете эксперимент или опрос, вы получите пары данных — независимую переменную обозначим как

, а зависимую или конечную переменную как

. Введите эти значения в первые два столбца таблицы.

- Не перепутайте данные. Помните, что определенному значению независимой переменной должно соответствовать конкретное значение зависимой переменной.

- Например, рассмотрим следующий набор пар данных:

- (1,2)

- (2,4)

- (3,5)

- (4,4)

- (5,5)

-

3

Вычислите линию регрессии. Сделайте это на основе представленных данных. Эта линия также называется линией наилучшего соответствия или линией наименьших квадратов. Расчет можно сделать вручную, но это довольно утомительно. Поэтому рекомендуем воспользоваться графическим калькулятором или онлайн-сервисом, которые быстро вычислят линию регрессии по вашим данным.[2]

- В этой статье предполагается, что уравнение линии регрессии дано (известно).

- В нашем примере линия регрессии описывается уравнением

.

-

4

Вычислите прогнозируемые значения по линии регрессии. С помощью уравнения линии регрессии можно вычислить прогнозируемые значения «y» для значений «x», которые есть и которых нет в наборе данных.

Реклама

-

1

Вычислите ошибку каждого прогнозируемого значения. В четвертом столбце таблицы запишите ошибку каждого прогнозируемого значения. В частности, вычтите прогнозируемое значение (

) из фактического (наблюдаемого) значения (

).[3]

- В нашем примере вычисления будут выглядеть так:

-

2

Вычислите квадраты ошибок. Возведите в квадрат каждое значение четвертого столбца, а результаты запишите в последнем (пятом) столбце таблицы.

- В нашем примере вычисления будут выглядеть так:

-

3

Найдите сумму квадратов ошибок. Она пригодится для вычисления стандартного отклонения, дисперсии и других величин. Чтобы найти сумму квадратов ошибок, сложите все значения пятого столбца. [4]

- В нашем примере вычисления будут выглядеть так:

- В нашем примере вычисления будут выглядеть так:

-

4

Завершите расчеты. Стандартная ошибка оценки — это квадратный корень из среднего значения суммы квадратов ошибок. Обычно ошибка оценки обозначается греческой буквой

. Поэтому сначала разделите сумму квадратов ошибок на число пар данных. А потом из полученного значения извлеките квадратный корень.[5]

- Если рассматриваемые данные представляют всю совокупность, среднее значение находится так: сумму нужно разделить на N (количество пар данных). Если же рассматриваемые данные представляют некоторую выборку, вместо N подставьте N-2.

- В нашем примере, скорее всего, имеет место выборка, потому что мы рассматриваем всего 5 пар данных. Поэтому стандартную ошибку оценки вычислите следующим образом:

-

5

Интерпретируйте полученный результат. Стандартная ошибка оценки — это статистический показатель, которые оценивает, насколько близко измеренные данные лежат к линии регрессии. Ошибка оценка «0» означает, что каждая точка лежит непосредственно на линии. Чем выше ошибка оценки, тем дальше от линии регрессии лежат точки.[6]

- В нашем примере выборка достаточно маленькая, поэтому стандартная оценка ошибки 0,894 является довольно низкой и характеризует близко расположенные данные.

Реклама

Об этой статье

Эту страницу просматривали 4342 раза.

Была ли эта статья полезной?

Стандартная ошибка оценки по уравнению регрессии

Стандартная ошибка оценки, также известная как стандартная ошибка уравнения регрессии, определяется следующим образом (см. (6.23)) [c.280]

Стандартная ошибка уравнения регрессии, Эта статистика SEE представляет собой стандартное отклонение фактических значений теоретических значений У. [c.650]

Что такое стандартная ошибка уравнения регрессии ).Какие допущения лежат в основе парной регрессии 10. Что такое множественная регрессия [c.679]

Следующий этап корреляционного анализа — расчет уравнения связи (регрессии). Решение проводится обычно шаговым способом. Сначала в расчет принимается один фактор, который оказывает наиболее значимое влияние на результативный показатель, потом второй, третий и т.д. И на каждом шаге рассчитываются уравнение связи, множественный коэффициент корреляции и детерминации, /»»-отношение (критерий Фишера), стандартная ошибка и другие показатели, с помощью которых оценивается надежность уравнения связи. Величина их на каждом шаге сравнивается с предыдущей. Чем выше величина коэффициентов множественной корреляции, детерминации и критерия Фишера и чем ниже величина стандартной ошибки, тем точнее уравнение связи описывает зависимости, сложившиеся между исследуемыми показателями. Если добавление следующих факторов не улучшает оценочных показателей связи, то надо их отбросить, т.е. остановиться на том уравнении, где эти показатели наиболее оптимальны. [c.149]

Прогнозное значение ур определяется путем подстановки в уравнение регрессии ух =а + Ьх соответствующего (прогнозного) значения хр. Вычисляется средняя стандартная ошибка прогноза [c.9]

В линейной регрессии обычно оценивается значимость не только уравнения в целом, но и отдельных его параметров. С этой целью по каждому из параметров определяется его стандартная ошибка ть и та. [c.53]

В прогнозных расчетах по уравнению регрессии определяется предсказываемое (ур) значение как точечный прогноз ух при хр =хь т. е. путем подстановки в уравнение регрессии 5 = а + b х соответствующего значения х. Однако точечный прогноз явно не реален. Поэтому он дополняется расчетом стандартной ошибки ух, т. е. Шух, и соответственно интервальной оценкой прогнозного значения (у ) [c.57]

Чтобы понять, как строится формула для определения величин стандартной ошибки ух, обратимся к уравнению линейной регрессии ух = а + b х. Подставим в это уравнение выражение параметра а [c.57]

При прогнозировании на основе уравнения регрессии следует помнить, что величина прогноза зависит не только от стандартной ошибки индивидуального значения у, но и от точности прогноза значения фактора х. Его величина может задаваться на основе анализа других моделей исходя из конкретной ситуации, а также из анализа динамики данного фактора. [c.61]

В скобках указаны стандартные ошибки параметров уравнения регрессии. [c.327]

В скобках указаны стандартные ошибки параметров уравнения регрессии. Определим по этому уравнению расчетные значения >>, ,, а затем параметры уравнения регрессии (7.44). Получим следующие результаты [c.328]

На каждом шаге рассматриваются уравнение регрессии, коэффициенты корреляции и детерминации, F-критерий, стандартная ошибка оценки и другие оценочные показатели. После каждого шага перечисленные оценочные показатели сравниваются с [c.39]

Проблемы с методологией регрессии. Методология регрессии — это традиционный способ уплотнения больших массивов данных и их сведения в одно уравнение, отражающее связь между мультипликаторами РЕ и финансовыми фундаментальными переменными. Но данный подход имеет свои ограничения. Во-первых, независимые переменные коррелируют друг с другом . Например, как видно из таблицы 18,2, обобщающей корреляцию между коэффициентами бета, ростом и коэффициентами выплат для всех американских фирм, быстрорастущие фирмы обычно имеют большой риск и низкие коэффициенты выплат. Обратите внимание на отрицательную корреляцию между коэффициентами выплат и ростом, а также на положительную корреляцию между коэффициентами бета и ростом. Эта мультиколлинеарность делает мультипликаторы регрессии ненадежными (увеличивает стандартную ошибку) и, возможно, объясняет ошибочные знаки при коэффициентах и крупные изменения этих мультипликаторов в разные периоды. Во-вторых, регрессия основывается на линейной связи между мультипликаторами РЕ и фундаментальными переменными, и данное свойство, по всей вероятности, неадекватно. Анализ остаточных явлений, связанных с корреляцией, может привести к трансформациям независимых переменных (их квадратов или натуральных логарифмов), которые в большей степени подходят для объяснения мультипликаторов РЕ. В-третьих, базовая связь между мультипликаторами РЕ и финансовыми переменными сама по себе не является стабильной. Если же эта связь смещается из года в год, то прогнозы, полученные из регрессионного уравнения, могут оказаться ненадежными для более длительных периодов времени. По всем этим причинам, несмотря на полезность регрессионного анализа, его следует рассматривать только как еще один инструмент поиска подлинного значения ценности. [c.649]

На рисунке 16.6 явно просматривается четкая линейная зависимость объема частного потребления от величины располагаемого дохода. Уравнение парной линейной регрессии, оцененное по этим данным, имеет вид С= -217,6 + 1,007 Yf Стандартные ошибки для свободного члена и коэффициента парной регрессии равны, соответственно, 28,4 и 0,012, а -статистики — -7,7 и 81 9. Обе они по модулю существенно превышают 3, следовательно, их статистическая значимость весьма высока. Впрочем, несмотря на то, что здесь удалось оценить статистически значимую линейную функцию потребления, в ней нарушены сразу две предпосылки Кейнса — уровень автономного потребления С0 оказался отрицательным, а предель- [c.304]

Стандартные ошибки свободного члена и коэффициента регрессии равны, соответственно, 84,7 и 0,46 их /-статистики — (-21,4 и 36,8). По абсолютной величине /-статистики намного превышают 3, и это свидетельствует о высокой надежности оцененных коэффициентов. Коэффициент детерминации /Р уравнения равен 0,96, то есть объяснено 96% дисперсии объема потребления. И в то же время уже по рисунку видно, что оцененная рефессия не очень хоро- [c.320]

Эта стандартная ошибка S у, равная 0,65, указывает отклонение фактических данных от прогнозируемых на основании использования воздействующих факторов j i и Х2 (влияние среди покупателей бабушек с внучками и высокопрофессионального вклада Шарика). В то же время мы располагаем обычным стандартным отклонением Sn, равным 1,06 (см. табл.8), которое было рассчитано для одной переменной, а именно сами текущие значения уги величина среднего арифметического у, которое равно 6,01. Легко видеть, что S у tTa6n. В противном случае доверять полученной оценке параметра нет оснований. [c.139]

Для определения профиля посетителей магазинов местного торгового центра, не имеющих определенной цели (browsers), маркетологи использовали три набора независимых переменных демографические, покупательское поведение психологические. Зависимая переменная представляет собой индекс посещения магазина без определенной цели, индекс (browsing index). Методом ступенчатой включающей все три набора переменных, выявлено, что демографические факторы — наиболее сильные предикторы, определяющие поведение покупателей, не преследующих конкретных целей. Окончательное уравнение регрессии, 20 из 36 возможных переменных, включало все демографические переменные. В следующей таблице приведены коэффициенты регрессии, стандартные ошибки коэффициентов, а также их уровни значимости. [c.668]

Смотреть страницы где упоминается термин Стандартная ошибка уравнения регрессии

Маркетинговые исследования Издание 3 (2002) — [ c.650 ]

Лекции по дисциплине «Эконометрика» (заочное отделение) (стр. 2 )

|

Из за большого объема этот материал размещен на нескольких страницах: 1 2 3 4 |

Параметр формально является значением Y при X = 0. Он может не иметь экономического содержания. Интерпретировать можно лишь знак при параметре . Если > 0, то относительное изменение результата происходит медленнее, чем изменение фактора. Иными словами, вариация по фактору X выше вариации для результата Y. Также считают, что включает в себя неучтенные в модели факторы.

По итогам 2008 года были собраны данные по прибыли и оборачиваемости оборотных средств 500 торговых предприятий г. Челябинска. Результаты наблюдения сведены в таблицу.

Годовая прибыль предприятия, млн. руб.

Годовая оборачиваемость оборотных средств, раз

Требуется построить зависимость прибыли предприятий от оборачиваемости оборотных средств и оценить качество полученного уравнения.

Пусть y – прибыль предприятия, x – оборачиваемость оборотных средств.

На основе исходных данных были рассчитаны следующие показатели:

Уровень доверия возьмем q=0,95 или 95%.

1. Стандартные ошибки оценок , . намного больше =0,39, следовательно, низкая точность коэффициента . очень мала по сравнению с , следовательно, высокая точность коэффициента .

2. Интервальные оценки коэффициентов уравнения регрессии.

n – 2 = 500 – 2 = 498;

α:

β:

3. Значимость коэффициентов регрессии.

4. Стандартная ошибка регрессии. Se=0,91, по сравнению со средним значением =34,5 ошибка невысокая, точность уравнения хорошая.

5. Коэффициент детерминации. R2 = rxy2=0,782=0,6084 не очень близко к 1, качество подгонки среднее.

6. Средняя ошибка аппроксимации. A=11%, качество подгонки уравнения среднее.

Экономическая интерпретация: при увеличении оборачиваемости оборотных средств предприятия на 1 раз в год средняя годовая прибыль увеличится на 5,86 млн. руб.

Тема 6. Нелинейная парная регрессия

Часто на практике между зависимой и независимыми переменными существует нелинейная форма взаимосвязи. В этом случае существует два выхода:

1) подобрать к анализируемым переменным преобразование, которое бы позволило представить существующую зависимость в виде линейной функции;

2) применить нелинейный метод наименьших квадратов.

Основные нелинейные регрессионные модели и приведение их к линейной форме

1. Экспоненциальное уравнение

Если прологарифмировать левую и правую части данного уравнения, то получится

Это уравнение является линейным, но вместо y в левой части стоит ln y.

В данном случае параметр β1 имеет следующий экономический смысл: при увеличении переменной x на единицу переменная y в среднем увеличится примерно на 100·β% (более точно: y увеличится в

2. Логарифмическое уравнение

Переход к линейному уравнению осуществляется заменой переменной x на X=lnx..

Параметр β1 имеет следующий экономический смысл: для увеличения y на единицу необходимо увеличить переменную x в

3. Гиперболическое уравнение

В этом случае необходимо сделать замену переменных x на

4. Степенное уравнение

Прологарифмировав левую и правую части данного уравнения, получим

Заменив соответствующие ряды их логарифмами, получится линейная регрессия.

Экономический смысл параметра β1: если значение переменной x увеличить на 1%, то y увеличится на β1%.

5. Показательное уравнение

Прологарифмировав левую и правую части уравнения, получим

Проведя замены Y=ln y и B1=ln β1, получится линейная регрессия.

Экономический смысл параметра β1: при увеличении переменной x на единицу переменная y в среднем увеличится в β1 раз.

Тема 7. Множественная линейная регрессия: определение и оценка параметров

1. Понятие множественной линейной регрессии

Модель множественной линейной регрессии является обобщением парной линейной регрессии и представляет собой следующее выражение:

где yt – значение зависимой переменной для наблюдения t,

xit – значение i-й независимой переменной для наблюдения t,

εt – значение случайной ошибки для наблюдения t,

n – число наблюдений,

m – число независимых переменных x.

2. Матричная форма записи множественной линейной регрессии

Уравнение множественной линейной регрессии можно записать в матричной форме:

где

3. Основные предположения

2.

3.

4.

В случае выполнения вышеперечисленных гипотез модель называется нормальной линейной регрессионной.

4. Метод наименьших квадратов

Параметры уравнения множественной регрессии оцениваются, как и в парной регрессии, методом наименьших квадратов (МНК):

Чтобы найти минимум этой функции необходимо вычислить производные по каждому из параметров и приравнять их к нулю, в результате получается система уравнений, решение которой в матричном виде следующее:

5. Теорема Гаусса-Маркова

Если выполнены предположения 1-5 из пункта 3, то оценки , полученные методом наименьших квадратов, имеют наименьшую дисперсию в классе линейных несмещенных оценок, то есть являются несмещенными, состоятельными и эффективными.

Тема 8. Множественная линейная регрессия: оценка качества

1. Общая схема проверки качества парной регрессии

Адекватность модели – остатки должны удовлетворять условиям теоремы Гаусса-Маркова.

Основные показатели качества коэффициентов регрессии:

1. Стандартные ошибки оценок (анализ точности определения оценок).

2. Интервальные оценки коэффициентов уравнения регрессии (построение доверительных интервалов).

3. Значимость коэффициентов регрессии (проверка гипотез относительно коэффициентов регрессии).

Основные показатели качества уравнения регрессии в целом:

1. Стандартная ошибка регрессии Se (анализ точности уравнения регрессии).

2. Значимость уравнения регрессии в целом (проверка гипотезы относительно всех коэффициентов регрессии).

3. Коэффициент детерминации R2 (проверка качества подгонки уравнения к исходным данным).

4. Скорректированный коэффициент детерминации R2adj (проверка качества подгонки уравнения к исходным данным).

5. Средняя ошибка аппроксимации (проверка качества подгонки уравнения к эмпирическим данным).

2. Стандартные ошибки оценок

Стандартные ошибки коэффициентов регрессии – это средние квадратические отклонения коэффициентов регрессии от их истинных значений.

где

Стандартная ошибка является оценкой среднего квадратического отклонения коэффициента регрессии от его истинного значения. Чем меньше стандартная ошибка тем точнее оценка.

3. Интервальные оценки коэффициентов множественной линейной регрессии

Доверительные интервалы для коэффициентов регрессии определяются следующим образом:

1. Выбирается уровень доверия q (0,9; 0,95 или 0,99).

2. Рассчитывается уровень значимости g = 1 – q.

3. Рассчитывается число степеней свободы n – m – 1, где n – число наблюдений, m – число независимых переменных.

4. Определяется критическое значение t-статистики (tкр) по таблицам распределения Стьюдента на основе g и n – m – 1.

5. Рассчитывается доверительный интервал для параметра

Доверительный интервал показывает, что истинное значение параметра с вероятностью q находится в данных пределах.

Чем меньше доверительный интервал относительно коэффициента, тем точнее полученная оценка.

4. Значимость коэффициентов регрессии

Процедура оценки значимости коэффициентов осуществляется аналогичной парной регрессии следующим образом:

1. Рассчитывается значение t-статистики для коэффициента регрессии по формуле

2. Выбирается уровень доверия q ( 0,9; 0,95 или 0,99).

3. Рассчитывается уровень значимости g = 1 – q.

4. Рассчитывается число степеней свободы n – m – 1, где n – число наблюдений, m – число независимых переменных.

5. Определяется критическое значение t-статистики (tкр) по таблицам распределения Стьюдента на основе g и n – m – 1.

6. Если

t-тесты обеспечивают проверку значимости предельного вклада каждой переменной при допущении, что все остальные переменные уже включены в модель.

5. Стандартная ошибка регрессии

Стандартная ошибка регрессии Se показывает, насколько в среднем фактические значения зависимой переменной y отличаются от ее расчетных значений

Используется как основная величина для измерения качества модели (чем она меньше, тем лучше).

Значения Se в однотипных моделях с разным числом наблюдений и (или) переменных сравнимы.

6. Оценка значимости уравнения регрессии в целом

Уравнение значимо, если есть достаточно высокая вероятность того, что существует хотя бы один коэффициент, отличный от нуля.

Имеются альтернативные гипотезы:

Если принимается гипотеза H0, то уравнение статистически незначимо. В противном случае говорят, что уравнение статистически значимо.

Значимость уравнения регрессии в целом осуществляется с помощью F-статистики.

Оценка значимости уравнения регрессии в целом основана на тождестве дисперсионного анализа:

TSS – общая сумма квадратов отклонений

ESS – объясненная сумма квадратов отклонений

RSS – необъясненная сумма квадратов отклонений

F-статистика представляет собой отношение объясненной суммы квадратов (в расчете на одну независимую переменную) к остаточной сумме квадратов (в расчете на одну степень свободы)

n – число выборочных наблюдений, m – число независимых переменных.

При отсутствии линейной зависимости между зависимой и независимой переменными F-статистика имеет F-распределение Фишера-Снедекора со степенями свободы k1 = m, k2 = n – m –1.

Процедура оценки значимости уравнения осуществляется следующим образом:

7. Рассчитывается значение F-статистики по формуле

8. Выбирается уровень доверия q ( 0,9; 0,95 или 0,99).

9. Рассчитывается уровень значимости g = 1 – q.

10. Рассчитывается число степеней свободы n – m – 1, где n – число наблюдений, m – число независимых переменных.

11. Определяется критическое значение F-статистики (Fкр) по таблицам распределения Фишера на основе g и n – m – 1.

12. Если

В парной регрессии F-статистика равна квадрату t-статистики:

Качество оценки уравнения можно проверить путем расчета коэффициента детерминации R2, который показывает степень соответствия найденного уравнения экспериментальным данным.

Коэффициент R2 показывает долю дисперсии переменной y, объясненную регрессией, в общей дисперсии y.

Коэффициент детерминации лежит в пределах 0 £ R2 £ 1.

Чем ближе R2 к 1, тем выше качество подгонки уравнения к статистическим данным.

Чем ближе R2 к 0, тем ниже качество подгонки уравнения к статистическим данным.

Коэффициенты R2 в разных моделях с разным числом наблюдений и переменных несравнимы.

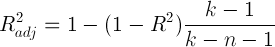

8. Скорректированный коэффициент детерминации R2adj

Низкое значение R2 не свидетельствует о плохом качестве модели, и может объясняться наличием существенных факторов, не включенных в модель

R2 всегда увеличивается с включением новой переменной. Поэтому его необходимо корректировать, и рассчитывают скорректированный коэффициент детерминации

Если R2adj выходит за пределы интервала [0;1], то его использовать нельзя.

Если при добавлении новой переменной в модель увеличивается не только R2, но и R2adj, то можно считать, что вклад этой переменной в повышение качества модели существенен.

9. Средняя ошибка аппроксимации

Средняя ошибка аппроксимации (средняя абсолютная процентная ошибка) – показывает в процентах среднее отклонение расчетных значений зависимой переменной от фактических значений yi

Если A ≤ 10%, то качество подгонки уравнения считается хорошим. Чем меньше значение A, тем лучше.

10. Использование показателей качества коэффициентов и уравнения регрессии для интерпретации и корректировки модели

В случае незначимости уравнения, необходимо устранить ошибки модели. Наиболее распространенными являются следующие ошибки:

— неправильно выбран вид функции регрессии;

— в модель включены незначимые регрессоры;

— в модели отсутствуют значимые регрессоры.

После устранения ошибок требуется заново оценить параметры уравнения и его качество, продолжая этот процесс до тех пор, пока качество уравнения не станет удовлетворительным. Если после поделанных процедур, мы не достигли требуемого уровня значимости, то необходимо устранять другие ошибки (спецификации, классификации, наблюдения и т. д., см. тему 3, п. 6).

11. Интерпретация множественной линейной регрессии

Коэффициент регрессии

В апреле 2006 года были собраны данные по стоимости 200 двухкомнатных квартир в Металлургическом районе г. Челябинска, их жилой площади, площади кухни и расстоянии до центра города (пл. Революции). Результаты наблюдения сведены в таблицу.

Оценка результатов линейной регрессии

Введение

Модель линейной регрессии

Итак, пусть есть несколько независимых случайных величин X1, X2, . Xn (предикторов) и зависящая от них величина Y (предполагается, что все необходимые преобразования предикторов уже сделаны). Более того, мы предполагаем, что зависимость линейная, а ошибки рапределены нормально, то есть

где I — единичная квадратная матрица размера n x n.

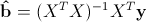

Итак, у нас есть данные, состоящие из k наблюдений величин Y и Xi и мы хотим оценить коэффициенты. Стандартным методом для нахождения оценок коэффициентов является метод наименьших квадратов. И аналитическое решение, которое можно получить, применив этот метод, выглядит так:

где b с крышкой — оценка вектора коэффициентов, y — вектор значений зависимой величины, а X — матрица размера k x n+1 (n — количество предикторов, k — количество наблюдений), у которой первый столбец состоит из единиц, второй — значения первого предиктора, третий — второго и так далее, а строки соответствуют имеющимся наблюдениям.

Функция summary.lm() и оценка получившихся результатов

Теперь рассмотрим пример построения модели линейной регрессии в языке R:

Таблица gala содержит некоторые данные о 30 Галапагосских островах. Мы будем рассматривать модель, где Species — количество разных видов растений на острове линейно зависит от нескольких других переменных.

Рассмотрим вывод функции summary.lm().

Сначала идет строка, которая напоминает, как строилась модель.

Затем идет информация о распределении остатков: минимум, первая квартиль, медиана, третья квартиль, максимум. В этом месте было бы полезно не только посмотреть на некоторые квантили остатков, но и проверить их на нормальность, например тестом Шапиро-Уилка.

Далее — самое интересное — информация о коэффициентах. Здесь потребуется немного теории.

Сначала выпишем следующий результат:

при этом сигма в квадрате с крышкой является несмещенной оценкой для реальной сигмы в квадрате. Здесь b — реальный вектор коэффициентов, а эпсилон с крышкой — вектор остатков, если в качестве коэффициентов взять оценки, полученные методом наименьших квадратов. То есть при предположении, что ошибки распределены нормально, вектор коэффициентов тоже будет распределен нормально вокруг реального значения, а его дисперсию можно несмещенно оценить. Это значит, что можно проверять гипотезу на равенство коэффициентов нулю, а следовательно проверять значимость предикторов, то есть действительно ли величина Xi сильно влияет на качество построенной модели.

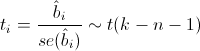

Для проверки этой гипотезы нам понадобится следующая статистика, имеющая распределение Стьюдента в том случае, если реальное значение коэффициента bi равно 0:

где

Теперь все готово для продолжения разбора вывода функции summary.lm().

Итак, далее идут оценки коэффициентов, полученные методом наименьших квадратов, их стандартные ошибки, значения t-статистики и p-значения для нее. Обычно p-значение сравнивается с каким-нибудь достаточно малым заранее выбранным порогом, например 0.05 или 0.01. И если значение p-статистики оказывается меньше порога, то гипотеза отвергается, если же больше, ничего конкретного, к сожалению, сказать нельзя. Напомню, что в данном случае, так как распределение Стьюдента симметричное относительно 0, то p-значение будет равно 1-F(|t|)+F(-|t|), где F — функция распределения Стьюдента с k-n-1 степенями свободы. Также, R любезно обозначает звездочками значимые коэффициенты, для которых p-значение достаточно мало. То есть, те коэффициенты, которые с очень малой вероятностью равны 0. В строке Signif. codes как раз содержится расшифровка звездочек: если их три, то p-значение от 0 до 0.001, если две, то оно от 0.001 до 0.01 и так далее. Если никаких значков нет, то р-значение больше 0.1.

В нашем примере можно с большой уверенностью сказать, что предикторы Elevation и Adjacent действительно с большой вероятностью влияют на величину Species, а вот про остальные предикторы ничего определенного сказать нельзя. Обычно, в таких случаях предикторы убирают по одному и смотрят, насколько изменяются другие показатели модели, например BIC или Adjusted R-squared, который будет разобран далее.

Значение Residual standart error соответствует просто оценке сигмы с крышкой, а степени свободы вычисляются как k-n-1.

А теперь самая важные статистики, на которые в первую очередь стоит смотреть: R-squared и Adjusted R-squared:

где Yi — реальные значения Y в каждом наблюдении, Yi с крышкой — значения, предсказанные моделью, Y с чертой — среднее по всем реальным значениям Yi.

Начнем со статистики R-квадрат или, как ее иногда называют, коэффициента детерминации. Она показывает, насколько условная дисперсия модели отличается от дисперсии реальных значений Y. Если этот коэффициент близок к 1, то условная дисперсия модели достаточно мала и весьма вероятно, что модель неплохо описывает данные. Если же коэффициент R-квадрат сильно меньше, например, меньше 0.5, то, с большой долей уверенности модель не отражает реальное положение вещей.

Однако, у статистики R-квадрат есть один серьезный недостаток: при увеличении числа предикторов эта статистика может только возрастать. Поэтому, может показаться, что модель с большим количеством предикторов лучше, чем модель с меньшим, даже если все новые предикторы никак не влияют на зависимую переменную. Тут можно вспомнить про принцип бритвы Оккама. Следуя ему, по возможности, стоит избавляться от лишних предикторов в модели, поскольку она становится более простой и понятной. Для этих целей была придумана статистика скорректированный R-квадрат. Она представляет собой обычный R-квадрат, но со штрафом за большое количество предикторов. Основная идея: если новые независимые переменные дают большой вклад в качество модели, значение этой статистики растет, если нет — то наоборот уменьшается.

Для примера рассмотрим ту же модель, что и раньше, но теперь вместо пяти предикторов оставим два:

Как можно увидеть, значение статистики R-квадрат снизилось, однако значение скорректированного R-квадрат даже немного возросло.

Теперь проверим гипотезу о равенстве нулю всех коэффициентов при предикторах. То есть, гипотезу о том, зависит ли вообще величина Y от величин Xi линейно. Для этого можно использовать следующую статистику, которая, если гипотеза о равенстве нулю всех коэффициентов верна, имеет распределение Фишера c n и k-n-1 степенями свободы:

Значение F-статистики и p-значение для нее находятся в последней строке вывода функции summary.lm().

Заключение

В этой статье были описаны стандартные методы оценки значимости коэффициентов и некоторые критерии оценки качества построенной линейной модели. К сожалению, я не касался вопроса рассмотрения распределения остатков и проверки его на нормальность, поскольку это увеличило бы статью еще вдвое, хотя это и достаточно важный элемент проверки адекватности модели.

Очень надеюсь что мне удалось немного расширить стандартное представление о линейной регрессии, как об алгоритме который просто оценивает некоторый вид зависимости, и показать, как можно оценить его результаты.

источники:

http://pandia.ru/text/78/101/1285-2.php

http://habr.com/ru/post/195146/

Ниворожкина Л.И. Основы статистики с элементами теории вероятностей для экономистов: Руководство для решения задач — файл n1.doc

приобрести

Ниворожкина Л.И. Основы статистики с элементами теории вероятностей для экономистов: Руководство для решения задач

скачать (17128 kb.)

Доступные файлы (1):

- Смотрите также:

- Рушайло М.Ф. Элементы теории вероятностей и математической статистики (Документ)

- Рушайло М.Ф. Элементы теории вероятностей и математической статистики (Документ)

- Кремер Н.Ш. Теория вероятностей и математическая статистика (Документ)

- Мордкович А.Г., Семенов П.В. События. Вероятности. Статистическая обработка данных: Дополнительные параграфы к курсу алгебры 7-9 кл. общеобразовательных учреждений (Документ)

- Гмурман В.Е. Руководство к решению задач по теории вероятностей и математической статистике (Документ)

- Гмурман В.Е. Руководство к решению задач по теории вероятностей и математической статистике (Документ)

- Гмурман В.Е. Руководство к решению задач по теории вероятностей и математической статистике (Документ)

- Гмурман В.Е. Руководство к решению задач по теории вероятностей и математической статистике (Документ)

- Гмурман В.Е. Руководство к решению задач по теории вероятностей и математической статистике (Документ)

- Кремер Н.Ш. Теория вероятностей и математическая статистика (Документ)

- Коваленко И.Н., Гнеденко Б.В. Теория вероятностей (Документ)

- Кафедра «Электроснабжение» В. Б. Козловская, В. В. Сталович математические задачи энергетики (Документ)

n1.doc

Хотя метод наименьших квадратов дает нам линию регрессии, которая обеспечивает минимум вариации, регрессионное уравнение не является идеальным в смысле предсказания, поскольку не все значения зависимого признака Y удовлетворяют уравнению регрессии. Нам необходима статистическая мера вариации фактических значений Y от предсказанных значений Y. Эта мера в то же время является средней вариацией каждого значения относительно среднего значения Y. Мера вариации относительно линии регрессии называется стандартной ошибкой оценки.

Колеблемость фактических значений признака Y относительно линии регрессии показана на рис. 9.3.

Из диаграммы видно, что хотя теоретическая линия регрессии проходит относительно близко от фактических значений Y, часть этих точек лежит выше или ниже линии регрессии. При этом

Стандартная ошибка оценки определяется как

где уi — фактические значения Y;

yx — предсказанные значения Y для заданного х.

Для вычисления более удобна следующая формула:

Нам уже известны

Тогда

Итак, для нашего примера: Syx = 0,497. Эта стандартная ошибка характеризует меру вариации фактических данных относительно линии регрессии. Интерпретация этой меры аналогична интерпретации среднего квадратического отклонения. Если среднее квадратическое отклонение — это мера вариации относительно средней, то стандартная ошибка — это оценка меры вариации относительно линии регрессии. Однако стандартная ошибка оценки может быть использована для выводов о значении yx и выяснения, является ли статистически значимой взаимосвязь между двумя переменными.

9.11. Измерение вариации по уравнению регрессии

Для проверки того, насколько хорошо независимая переменная предсказывает зависимую переменную в нашей модели, необходим расчет ряда мер вариации. Первая из них — общая (полная) сумма квадратов отклонений результативного признака от средней — есть мера вариации значений Y относительно их среднего Y . В регрессионном анализе общая сумма квадратов может быть разложена на объясняемую вариацию или сумму квадратов отклонений за счет регрессии и необъясняемую вариацию или остаточную сумму квадратов отклонений (рис. 9.4).

Сумма квадратов отклонений вследствие регрессии это — сумма квадратов разностей между y

(средним значением Y) и yx (значением Y, предсказанным по уравнению регрессии). Сумма квадратов отклонений, не объясняемая регрессией (остаточная сумма квадратов), — это сумма квадратов разностей y и yx . Эти меры вариации могут быть представлены следующим образом (табл. 9.8):

Таблица 9.8

| Общая сумма квадратов

(ST) |

= | Сумма квадратов за счет регрессии

(SR) |

+ | Остаточная сумма квадратов

(SE) |

Легко увидеть, что остаточная сумма квадратов (y-yx)2 — это выражение, стоящее под знаком корня в формуле (9.25) (стандартной ошибки оценки). Тем не менее в процессе вычислений стандартной ошибки мы всегда вначале вычисляем сумму квадратов ошибки.

Остаточная сумма квадратов может быть представлена следующим образом:

Объясняемая сумма квадратов выразится так:

В самом деле

51,3605 = 46,9145 + 4,4460.

Из этого соотношения определяется коэффициент детерминации:

Отсюда коэффициент детерминации — доля вариации Y, которая объясняется независимыми переменными в регрессионной модели. Для нашего примера rг= 46,9145/51,3605 = 0,913.

Следовательно, 91,3% вариации еженедельной выручки магазинов могут быть объяснены числом покупателей, варьирующим от магазина к магазину. Только 8,7% вариации можно объяснить иными факторами, не включенными в уравнение регрессии.

В случае парной регрессии коэффициент детерминации равен квадратному корню из квадрата коэффициента линейной корреляции Пирсона

В простой линейной регрессии г имеет тот же знак, что и b1, Если b1 > 0, то r > 0; если b1 < 0, то r < 0, если b1 = 0, то r = 0.

В нашем примере r2 = 0,913 и b1 > 0, коэффициент корреляции r = 0,956. Близость коэффициента корреляции к 1 свидетельствует о тесной положительной связи между выручкой магазина от продажи пива и числом посетителей.

Мы интерпретировали коэффициент корреляции в терминах регрессии, однако корреляция и регрессия — две различные техники. Корреляция устанавливает силу связи между признаками, а регрессия — форму этой связи. В ряде случаев для анализа достаточно найти меру связи между признаками, без использования одного из них в качестве факторного признака для другого.

9.12. Доверительные интервалы для оценки неизвестного генерального значения yген(yх) и индивидуального значения yi

Поскольку в основном для построения регрессионных моделей используются данные выборок, то зачастую интерпретация взаимоотношений между переменными в генеральной совокупности базируется на выборочных результатах.

Как было сказано выше, регрессионное уравнение используется для прогноза значений Y по заданному значению X. В нашем примере показано, что при 600 посетителях магазина сумма выручки могла бы быть 7,661 у. е. Однако это значение — только точечная оценка истинного среднего значения. Мы знаем, что для оценки истинного значения генерального параметра возможна интервальная оценка.

Доверительный интервал для оценки неизвестного генерального значения yген(yх) имеет вид

где

Здесь yx — предсказанное значение Y

(yx==b0+b1yi);

Syx — стандартная ошибка оценки;

п — объем выборки;

хi — заданное значение X.

Легко видеть, что длина доверительного интервала зависит от нескольких факторов. Для заданного уровня значимости увеличение вариации вокруг линии регрессии, измеряемой стандартной ошибкой оценки, увеличивает длину интервала. Увеличение объема выборки уменьшит длину интервала. Более того, ширина интервала также варьирует с различными значениями X. Когда оценивается yx по значениям X, близким к x, то интервал тем уже, чем меньше абсолютное отклонение хi от x (рис. 9.5).

Когда оценка осуществляется по значениям X, удаленным от среднего x, то длина интервала возрастает.

Рассчитаем 95%-й доверительный интервал для среднего значения выручки во всех магазинах с числом посетителей, равным 600. По данным нашего примера уравнение регрессии имеет вид

yx = 2,423 + 0,00873x:

и для xi = 600 получим yi; =7,661, а также

По таблице Стьюдента (приложение 5)

t18 = 2,10.

Отсюда, используя формулы (9.31) и (9.32), рассчитаем границы искомого доверительного интервала для yx

Итак, 7,369 yx 7,953.

Следовательно, наша оценка состоит в том, что средняя дневная выручка находится между 7,369 и 7,953 у. е. для всех магазинов с 600 посетителями.

Для построения доверительного интервала для индивидуальных значений Yx, лежащих на линии регрессии, используется доверительный интервал регрессии вида

где hi yi, , Syx ,п и хi — определяются, как и в формулах (9.31) и (9.32).

Определим 95% -и доверительный интервал для оценки дневных продаж отдельного магазина с 600 посетителями

В результате вычислений получим

Итак, 6,577 yi 8,745.

Следовательно, с 95%-й уверенностью можно утверждать, что ежедневная выручка отдельного магазина, который посетили 600 покупателей, находится в пределах от 6,577 до 8,745 у. е. Длина этого интервала больше чем длина интервала, полученного ранее для оценки среднего значения Y.

9.10. Стандартная ошибка оценки уравнения регрессии

Download Article

Download Article

The standard error of estimate is used to determine how well a straight line can describe values of a data set. When you have a collection of data from some measurement, experiment, survey or other source, you can create a line of regression to estimate additional data. With the standard error of estimate, you get a score that describes how good the regression line is.

-

1

Create a five column data table. Any statistical work is generally made easier by having your data in a concise format. A simple table serves this purpose very well. To calculate the standard error of estimate, you will be using five different measurements or calculations. Therefore, creating a five-column table is helpful. Label the five columns as follows:[1]

-

2

Enter the data values for your measured data. After collecting your data, you will have pairs of data values. For these statistical calculations, the independent variable is labeled

and the dependent, or resulting, variable is

. Enter these values into the first two columns of your data table.[2]

- The order of the data and the pairing is important for these calculations. You need to be careful to keep your paired data points together in order.

- For the sample calculations shown above, the data pairs are as follows:

- (1,2)

- (2,4)

- (3,5)

- (4,4)

- (5,5)

Advertisement

-

3

Calculate a regression line. Using your data results, you will be able to calculate a regression line. This is also called a line of best fit or the least squares line. The calculation is tedious but can be done by hand. Alternatively, you can use a handheld graphing calculator or some online programs that will quickly calculate a best fit line using your data.[3]

- For this article, it is assumed that you will have the regression line equation available or that it has been predicted by some prior means.

- For the sample data set in the image above, the regression line is

.

-

4

Calculate predicted values from the regression line. Using the equation of that line, you can calculate predicted y-values for each x-value in your study, or for other theoretical x-values that you did not measure.[4]

Advertisement

-

1

Calculate the error of each predicted value. In the fourth column of your data table, you will calculate and record the error of each predicted value. Specifically, subtract the predicted value (

) from the actual observed value (

).[5]

- For the data in the sample set, these calculations are as follows:

-

2

Calculate the squares of the errors. Take each value in the fourth column and square it by multiplying it by itself. Fill in these results in the final column of your data table.

- For the sample data set, these calculations are as follows:

-

3

Find the sum of the squared errors (SSE). The statistical value known as the sum of squared errors (SSE) is a useful step in finding standard deviation, variance and other measurements. To find the SSE from your data table, add the values in the fifth column of your data table.[6]

- For this sample data set, this calculation is as follows:

- For this sample data set, this calculation is as follows:

-

4

Finalize your calculations. The Standard Error of the Estimate is the square root of the average of the SSE. It is generally represented with the Greek letter

. Therefore, the first calculation is to divide the SSE score by the number of measured data points. Then, find the square root of that result.[7]

- If the measured data represents an entire population, then you will find the average by dividing by N, the number of data points. However, if you are working with a smaller sample set of the population, then substitute N-2 in the denominator.

- For the sample data set in this article, we can assume that it is a sample set and not a population, just because there are only 5 data values. Therefore, calculate the Standard Error of the Estimate as follows:

-

5

Interpret your result. The Standard Error of the Estimate is a statistical figure that tells you how well your measured data relates to a theoretical straight line, the line of regression. A score of 0 would mean a perfect match, that every measured data point fell directly on the line. Widely scattered data will have a much higher score.[8]

- With this small sample set, the standard error score of 0.894 is quite low and represents well organized data results.

Advertisement

Ask a Question

200 characters left

Include your email address to get a message when this question is answered.

Submit

Advertisement

Video

Thanks for submitting a tip for review!

References

About This Article

Article SummaryX

To calculate the standard error of estimate, create a five-column data table. In the first two columns, enter the values for your measured data, and enter the values from the regression line in the third column. In the fourth column, calculate the predicted values from the regression line using the equation from that line. These are the errors. Fill in the fifth column by multiplying each error by itself. Add together all of the values in column 5, then take the square root of that number to get the standard error of estimate. To learn how to organize the data pairs, keep reading!

Did this summary help you?

Thanks to all authors for creating a page that has been read 186,800 times.

Did this article help you?

Download Article

Download Article

The standard error of estimate is used to determine how well a straight line can describe values of a data set. When you have a collection of data from some measurement, experiment, survey or other source, you can create a line of regression to estimate additional data. With the standard error of estimate, you get a score that describes how good the regression line is.

-

1

Create a five column data table. Any statistical work is generally made easier by having your data in a concise format. A simple table serves this purpose very well. To calculate the standard error of estimate, you will be using five different measurements or calculations. Therefore, creating a five-column table is helpful. Label the five columns as follows:[1]

-

2

Enter the data values for your measured data. After collecting your data, you will have pairs of data values. For these statistical calculations, the independent variable is labeled

and the dependent, or resulting, variable is

. Enter these values into the first two columns of your data table.[2]

- The order of the data and the pairing is important for these calculations. You need to be careful to keep your paired data points together in order.

- For the sample calculations shown above, the data pairs are as follows:

- (1,2)

- (2,4)

- (3,5)

- (4,4)

- (5,5)

Advertisement

-

3

Calculate a regression line. Using your data results, you will be able to calculate a regression line. This is also called a line of best fit or the least squares line. The calculation is tedious but can be done by hand. Alternatively, you can use a handheld graphing calculator or some online programs that will quickly calculate a best fit line using your data.[3]

- For this article, it is assumed that you will have the regression line equation available or that it has been predicted by some prior means.

- For the sample data set in the image above, the regression line is

.

-

4

Calculate predicted values from the regression line. Using the equation of that line, you can calculate predicted y-values for each x-value in your study, or for other theoretical x-values that you did not measure.[4]

Advertisement

-

1

Calculate the error of each predicted value. In the fourth column of your data table, you will calculate and record the error of each predicted value. Specifically, subtract the predicted value (

) from the actual observed value (

).[5]

- For the data in the sample set, these calculations are as follows:

-

2

Calculate the squares of the errors. Take each value in the fourth column and square it by multiplying it by itself. Fill in these results in the final column of your data table.

- For the sample data set, these calculations are as follows:

-

3

Find the sum of the squared errors (SSE). The statistical value known as the sum of squared errors (SSE) is a useful step in finding standard deviation, variance and other measurements. To find the SSE from your data table, add the values in the fifth column of your data table.[6]

- For this sample data set, this calculation is as follows:

- For this sample data set, this calculation is as follows:

-

4

Finalize your calculations. The Standard Error of the Estimate is the square root of the average of the SSE. It is generally represented with the Greek letter

. Therefore, the first calculation is to divide the SSE score by the number of measured data points. Then, find the square root of that result.[7]

- If the measured data represents an entire population, then you will find the average by dividing by N, the number of data points. However, if you are working with a smaller sample set of the population, then substitute N-2 in the denominator.

- For the sample data set in this article, we can assume that it is a sample set and not a population, just because there are only 5 data values. Therefore, calculate the Standard Error of the Estimate as follows:

-

5

Interpret your result. The Standard Error of the Estimate is a statistical figure that tells you how well your measured data relates to a theoretical straight line, the line of regression. A score of 0 would mean a perfect match, that every measured data point fell directly on the line. Widely scattered data will have a much higher score.[8]

- With this small sample set, the standard error score of 0.894 is quite low and represents well organized data results.

Advertisement

Ask a Question

200 characters left

Include your email address to get a message when this question is answered.

Submit

Advertisement

Video

Thanks for submitting a tip for review!

References

About This Article

Article SummaryX

To calculate the standard error of estimate, create a five-column data table. In the first two columns, enter the values for your measured data, and enter the values from the regression line in the third column. In the fourth column, calculate the predicted values from the regression line using the equation from that line. These are the errors. Fill in the fifth column by multiplying each error by itself. Add together all of the values in column 5, then take the square root of that number to get the standard error of estimate. To learn how to organize the data pairs, keep reading!

Did this summary help you?

Thanks to all authors for creating a page that has been read 186,800 times.

Did this article help you?

Ранее мы рассматривали пример анализа, где аналитик оценивал средние планируемые капитальные затраты клиентов на телекоммуникационное оборудование.

Если предположить, что выборка репрезентативна для совокупности, то как аналитик может оценить ошибку выборки при расчете среднего значения по совокупности?

Рассматриваемое как формула, которая использует функцию случайных исходов случайной величины, выборочное среднее само по себе является случайной величиной с распределением вероятностей. Это распределение вероятностей называется выборочным распределением статистики (англ. ‘sampling distribution’).

Иногда возникает путаница, потому что термин «выборочное среднее» также используется в другом смысле. При расчете выборочного среднего для конкретной выборки, мы получаем определенное число, скажем, 8.

Если мы говорим, что «выборочное среднее равно 8», мы используем термин «выборочное среднее» в смысле конкретного исхода выборочного среднего как случайной величины. Число 8 является, конечно же, постоянной величиной и не имеет распределения вероятностей.

В данном обсуждении, мы не рассматриваем «выборочное среднее» как постоянную величину, относящуюся к конкретной выборке.

Для того, чтобы оценить, насколько близко выборочное среднее к среднему по совокупности, аналитик должен понимать распределение выборочного среднего. К счастью, у нас есть для этого инструмент, — центральная предельная теорема, которая помогает нам понять распределение выборочного среднего для многих задач оценивания, с которыми мы сталкиваемся.

Центральная предельная теорема.

Центральная предельная теорема — одна из наиболее практически полезных теорем теории вероятностей. Она имеет важное значение для того, как мы строим доверительные интервалы и проверяем статистические гипотезы.

Формально она формулируется следующим образом:

Для данной генеральной совокупности, описанной любым распределением вероятностей, имеющим среднее ( mu ) и конечную дисперсию ( sigma^2 ), распределение выборочного среднего ( overline X), вычисленное по выборке размера (n) из этой совокупности будет приблизительно нормальным со средним ( mu ) (среднее значение совокупности) и дисперсией ( sigma^2 / n ) (дисперсия совокупности деленная на n), при большом размере выборки (n).

Центральная предельная теорема позволяет сделать довольно точные вероятностные утверждения о среднем значении совокупности на основе выборочного среднего, независимо от размера распределения совокупности (так как оно имеет конечную дисперсию), потому что выборочное среднее приблизительно соответствует нормальному распределению для выборок большого размера.

Тут сразу возникает очевидный вопрос:

«Какой размер выборки можно считать достаточно большим, чтобы мы могли считать, что выборочное среднее соответствует нормальному распределению?»

В целом, если размер выборки ( n ) больше или равен 30, то можно считать, что выборочное среднее приблизительно нормально распределено.

Если генеральная совокупность сильно отличается от нормального распределения, то чтобы получить нормальное распределение, хорошо описывающее распределение выборочного среднего, необходим размер выборки намного больше 30.

Центральная предельная теорема утверждает, что дисперсия распределения выборочного среднего равна ( sigma^2 / n ). Положительный квадратный корень из дисперсии является стандартным отклонением.

Стандартное отклонение выборочной статистики также называют стандартной ошибкой статистики (англ. ‘standard error’).

Стандартная ошибка выборочного среднего является важной величиной в применении центральной предельной теоремы на практике.

Определение стандартной ошибки среднего значения выборки.

Для среднего значения выборки ( overline X) рассчитанного на основе выборки из совокупности со стандартным отклонением ( sigma ), стандартная ошибка среднего значения выборки определяется одним из двух выражений:

( Large dst sigma_{overline X} = {sigma over sqrt n} ) (Формула 1)

когда мы знаем стандартное отклонение совокупности ( sigma ), или

( Large dst s_{overline X} = {s over sqrt n} ) (Формула 2)

когда нам не известно стандартное отклонение совокупности и необходимо использовать стандартное отклонение выборки (s), чтобы оценить его.

Необходимо отметить технический момент: Когда мы делаем выборку размера (n) из конечной совокупности размера (N), мы применяем уменьшающий коэффициент к стандартной ошибке выборочного среднего, который называется поправкой для конечной совокупности (или FPC, от англ. ‘finite population correction factor’).

FPC равна ( [(N — n)/(N — 1)]^{1/2} ).

Таким образом, если (N = 100) и (n = 20), то ( [(100 — 20)/(100 — 1)]^{1/2} = 0.898933 ).

Если мы рассчитали стандартную ошибку равную, скажем, 20, в соответствии с Формулой 1 или Формулой 2, то оценка ошибки с поправкой составляет ( 20(0.898933) = 17.978663 ).

FPC применяется только когда мы делаем выборку из конечной совокупности без замены.

На практике, большинство аналитиков не применяют FPC, если размер выборки (n) слишком мал по сравнению с ( N ) (скажем, менее 5% от (N) ).

Для получения дополнительной информации о поправке для конечной совокупности см. Daniel and Terrell (1995).

На практике, нам почти всегда приходится использовать Формулу 2. Стандартное отклонение выборки (s) можно рассчитать, найдя квадратный корень из дисперсии выборки (s^2), которая рассчитывается следующим образом:

( Large dst

s^2 = {dsum_{i=1}^{n} big ( X_i — overline {X} big )^2 over n-1 } ) (Формула 3)

Мы скоро увидим, как мы можем использовать среднее значение выборки и его стандартную ошибку, чтобы сделать вероятностные утверждения о среднем значении совокупности, используя технику доверительных интервалов.

Но сначала мы проиллюстрируем всю силу центральной предельной теоремы.

Пример (3) применения центральной предельной теоремы.

Примечательно, что выборочное среднее для выборок больших размеров будет распределяться нормально, независимо от распределения генеральной совокупности.

Чтобы проиллюстрировать центральную предельную теорему в действии, мы используем в этом примере явное ненормальное распределение и используем его для создания большого количества случайных выборок размером 100.

Затем мы рассчитываем выборочное среднее для каждой выборки. Частотное распределение рассчитываемых выборочных средних является приближением распределения выборочного среднего для данного размера выборки.

Выглядит ли выборочное распределение как нормальное распределение?

Вернемся к примеру с аналитиком, изучающим планы капитальных затрат клиентов на покупку телекоммуникационного оборудования.

Предположим, что капитальные затраты на оборудование образуют непрерывную равномерную случайную величину с нижним пределом равным $0, и верхним пределом, равным $100. Для краткости, обозначим эту равномерную случайную величину как (0, 100).

Функция вероятности этой непрерывной равномерной случайной величины имеет довольно простую форму, не соответствующую нормальному распределению. Это горизонтальная линия с пересечением на вертикальной оси в точке 1/100. В отличии от нормальной случайной величины, для которой близкие к среднему исходы были бы наиболее вероятны, для равномерной случайной величины все возможные исходы равновероятны.

Чтобы проиллюстрировать силу центральной предельной теоремы, мы проводим моделирование методом Монте-Карло для изучения планируемых капитальных расходов на телекоммуникационное оборудование.

Моделирование методом Монте-Карло предполагает использование компьютера, чтобы смоделировать работу рассматриваемой системы с учетом риска. Составной частью моделирования методом Монте-Карло является генерация большого числа случайных выборок из заданного распределения вероятностей или распределений.

[см. также: CFA — Метод Монте-Карло]

В этом моделировании мы делаем 200 случайных выборок капитальных затрат 100 компаний (200 сгенерированных случайных исходов, каждый из которых состоит из капитальных затрат 100 компаний при (n = 100 )).

В каждом испытании моделирования, 100 значений капитальных затрат генерируются из равномерного распределения (0, 100). Для каждой случайной выборки, мы вычисляем выборочное среднее. Всего мы проводим 200 имитационных испытаний.

Поскольку мы определили распределение, генерирующее выборки, мы знаем, что средние капитальные затраты генеральной совокупности равны ($0 + $100 млн.)/2 = $50 млн.; дисперсия капитальных затрат совокупности равна ( (100 — 0)^2/12 = 833.33 ).

Таким образом, стандартное отклонение составляет $28.87 млн. и стандартная ошибка равна ( 28.87 Big / sqrt {100} = 2.887 ) в соответствии с центральной предельной теоремой.

Если ( a ) является нижним пределом равномерной случайной величины и ( b ) является верхним пределом, то среднее значение случайной величины определяется по формуле ( (a + b)/2 ), а ее дисперсия определяется по формуле ( (b — a)^2/12 ).

В чтении об обычных распределениях вероятности подробно описаны непрерывные равномерные случайные величины.

Результаты этого моделирования методом Монте-Карло приведены в Таблице 2 в виде частотного распределения. Это распределение является рассчитанным выборочным распределением среднего значения.

|

Диапазон выборки |

Абсолютная частота |

|---|---|

|

42.5 (leq overline X <) 44 |

1 |

|

44 (leq overline X <) 45.5 |

6 |

|

45.5 (leq overline X <)47 |

22 |

|

47 (leq overline X <) 48.5 |

39 |

|

48.5 (leq overline X <) 50 |

41 |

|

50 (leq overline X <) 51.5 |

39 |

|

51.5 (leq overline X <) 53 |

23 |

|

53 (leq overline X <) 54.5 |

12 |

|

54.5 (leq overline X <) 56 |

12 |

|

56 (leq overline X <) 57.5 |

5 |

Примечание: ( overline X ) представляет собой средние капитальные затраты для каждой выборки.

Полученное распределение частот можно описать как колоколообразное, с центром, расположенным близко к среднему значению совокупности: 50. Наиболее частый или модальный диапазон, с 41 наблюдениями: от 48.5 до 50.

Общее среднее выборочных средних составляет $49.92, со стандартной ошибкой, равной $2.80. Рассчитанная стандартная ошибка близка к значению 2.887, заданному центральной предельной теоремой.

Расхождение между вычисленными и ожидаемыми значениями среднего и стандартного отклонения, полученными в соответствии с центральной предельной теоремой, является результатом случайности (ошибка выборки).

Таким образом, хотя распределение совокупности очень не нормальное, моделирование показало, что нормальное распределение хорошо описывает рассчитанное распределение выборочного среднего. При этом среднее и стандартная ошибка приближительно равны значениям, предсказанным с помощью центральной предельной теоремы.

Итак, в соответствии с центральной предельной теоремой, когда мы делаем выборку из любого распределения, распределение выборочного среднего будет иметь следующие свойства, если размер нашей выборки достаточно велик:

- Распределение выборочного среднего ( overline X) будет приблизительно соответствовать нормальному распределению.

- Среднее значение распределения ( overline X) будет равно среднему значению генеральной совокупности, из которой сделана выборка.

- Дисперсия распределения ( overline X) будет равна дисперсии совокупности, деленной на размер выборки.

Далее мы обсудим концепции и инструменты, связанные с оценкой параметров совокупности, с особым акцентом на среднее значение совокупности.

Мы фокусируем внимание на среднем значении совокупности, потому что интервальные оценки среднего значения совокупности интересуют финансовых аналитиков, как правило, больше, чем любой другой тип интервальных оценок.