From Wikipedia, the free encyclopedia

| 7 bits of data | (count of 1-bits) | 8 bits including parity | |

|---|---|---|---|

| even | odd | ||

| 0000000 | 0 | 00000000 | 00000001 |

| 1010001 | 3 | 10100011 | 10100010 |

| 1101001 | 4 | 11010010 | 11010011 |

| 1111111 | 7 | 11111111 | 11111110 |

A parity bit, or check bit, is a bit added to a string of binary code. Parity bits are a simple form of error detecting code. Parity bits are generally applied to the smallest units of a communication protocol, typically 8-bit octets (bytes), although they can also be applied separately to an entire message string of bits.

The parity bit ensures that the total number of 1-bits in the string is even or odd.[1] Accordingly, there are two variants of parity bits: even parity bit and odd parity bit. In the case of even parity, for a given set of bits, the bits whose value is 1 are counted. If that count is odd, the parity bit value is set to 1, making the total count of occurrences of 1s in the whole set (including the parity bit) an even number. If the count of 1s in a given set of bits is already even, the parity bit’s value is 0. In the case of odd parity, the coding is reversed. For a given set of bits, if the count of bits with a value of 1 is even, the parity bit value is set to 1 making the total count of 1s in the whole set (including the parity bit) an odd number. If the count of bits with a value of 1 is odd, the count is already odd so the parity bit’s value is 0. Even parity is a special case of a cyclic redundancy check (CRC), where the 1-bit CRC is generated by the polynomial x+1.

Parity[edit]

In mathematics parity can refer to the evenness or oddness of an integer, which, when written in its binary form, can be determined just by examining only its least significant bit.

In information technology parity refers to the evenness or oddness, given any set of binary digits, of the number of those bits with value one. Because parity is determined by the state of every one of the bits, this property of parity—being dependent upon all the bits and changing its value from even to odd parity if any one bit changes—allows for its use in error detection and correction schemes.

In telecommunications the parity referred to by some protocols is for error-detection. The transmission medium is preset, at both end points, to agree on either odd parity or even parity. For each string of bits ready to transmit (data packet) the sender calculates its parity bit, zero or one, to make it conform to the agreed parity, even or odd. The receiver of that packet first checks that the parity of the packet as a whole is in accordance with the preset agreement, then, if there was a parity error in that packet, requests a re-transmission of that packet.

In computer science the parity stripe or parity disk in a RAID provides error-correction. Parity bits are written at the rate of one parity bit per n bits, where n is the number of disks in the array. When a read error occurs, each bit in the error region is recalculated from its set of n bits. In this way, using one parity bit creates «redundancy» for a region from the size of one bit to the size of one disk. See § Redundant Array of Independent Disks below.

In electronics, transcoding data with parity can be very efficient, as XOR gates output what is equivalent to a check bit that creates an even parity, and XOR logic design easily scales to any number of inputs. XOR and AND structures comprise the bulk of most integrated circuitry.

Error detection[edit]

If an odd number of bits (including the parity bit) are transmitted incorrectly, the parity bit will be incorrect, thus indicating that a parity error occurred in the transmission. The parity bit is only suitable for detecting errors; it cannot correct any errors, as there is no way to determine which particular bit is corrupted. The data must be discarded entirely, and re-transmitted from scratch. On a noisy transmission medium, successful transmission can therefore take a long time, or even never occur. However, parity has the advantage that it uses only a single bit and requires only a number of XOR gates to generate. See Hamming code for an example of an error-correcting code.

Parity bit checking is used occasionally for transmitting ASCII characters, which have 7 bits, leaving the 8th bit as a parity bit.

For example, the parity bit can be computed as follows. Assume Alice and Bob are communicating and Alice wants to send Bob the simple 4-bit message 1001.

| Type of bit parity | Successful transmission scenario |

|---|---|

| Even parity |

Alice wants to transmit: 1001 and 1011 Alice computes parity bit value: Alice adds parity bit and sends: Bob receives: 10010 and 10111 Bob computes parity: Bob reports correct transmission after observing expected even result. |

| Odd parity |

Alice wants to transmit: 1001 and 1011 Alice computes parity bit value: Alice adds parity bit and sends: Bob receives: 10011 and 10110 Bob computes overall parity: Bob reports correct transmission after observing expected odd result. |

This mechanism enables the detection of single bit errors, because if one bit gets flipped due to line noise, there will be an incorrect number of ones in the received data. In the two examples above, Bob’s calculated parity value matches the parity bit in its received value, indicating there are no single bit errors. Consider the following example with a transmission error in the second bit using XOR:

| Type of bit parity error | Failed transmission scenario |

|---|---|

| Even parity

Error in the second bit |

Alice wants to transmit: 1001

Alice computes parity bit value: 1^0^0^1 = 0 Alice adds parity bit and sends: 10010 …TRANSMISSION ERROR… Bob receives: 11010 Bob computes overall parity: 1^1^0^1^0 = 1 Bob reports incorrect transmission after observing unexpected odd result. |

| Even parity

Error in the parity bit |

Alice wants to transmit: 1001

Alice computes even parity value: 1^0^0^1 = 0 Alice sends: 10010 …TRANSMISSION ERROR… Bob receives: 10011 Bob computes overall parity: 1^0^0^1^1 = 1 Bob reports incorrect transmission after observing unexpected odd result. |

There is a limitation to parity schemes. A parity bit is only guaranteed to detect an odd number of bit errors. If an even number of bits have errors, the parity bit records the correct number of ones, even though the data is corrupt. (See also Error detection and correction.) Consider the same example as before with an even number of corrupted bits:

| Type of bit parity error | Failed transmission scenario |

|---|---|

| Even parity

Two corrupted bits |

Alice wants to transmit: 1001

Alice computes even parity value: 1^0^0^1 = 0 Alice sends: 10010 …TRANSMISSION ERROR… Bob receives: 11011 Bob computes overall parity: 1^1^0^1^1 = 0 Bob reports correct transmission though actually incorrect. |

Bob observes even parity, as expected, thereby failing to catch the two bit errors.

Usage[edit]

Because of its simplicity, parity is used in many hardware applications where an operation can be repeated in case of difficulty, or where simply detecting the error is helpful. For example, the SCSI and PCI buses use parity to detect transmission errors, and many microprocessor instruction caches include parity protection. Because the I-cache data is just a copy of main memory, it can be disregarded and re-fetched if it is found to be corrupted.

In serial data transmission, a common format is 7 data bits, an even parity bit, and one or two stop bits. This format accommodates all the 7-bit ASCII characters in an 8-bit byte. Other formats are possible; 8 bits of data plus a parity bit can convey all 8-bit byte values.

In serial communication contexts, parity is usually generated and checked by interface hardware (e.g., a UART) and, on reception, the result made available to a processor such as the CPU (and so too, for instance, the operating system) via a status bit in a hardware register in the interface hardware. Recovery from the error is usually done by retransmitting the data, the details of which are usually handled by software (e.g., the operating system I/O routines).

When the total number of transmitted bits, including the parity bit, is even, odd parity has the advantage that the all-zeros and all-ones patterns are both detected as errors. If the total number of bits is odd, only one of the patterns is detected as an error, and the choice can be made based on which is expected to be the more common error.

RAID array[edit]

Parity data is used by RAID arrays (redundant array of independent/inexpensive disks) to achieve redundancy. If a drive in the array fails, remaining data on the other drives can be combined with the parity data (using the Boolean XOR function) to reconstruct the missing data.

For example, suppose two drives in a three-drive RAID 5 array contained the following data:

| Drive 1: | 01101101 |

| Drive 2: | 11010100 |

To calculate parity data for the two drives, an XOR is performed on their data:

| 01101101 | |

| XOR | 11010100 |

| 10111001 |

The resulting parity data, 10111001, is then stored on Drive 3.

Should any of the three drives fail, the contents of the failed drive can be reconstructed on a replacement drive by subjecting the data from the remaining drives to the same XOR operation. If Drive 2 were to fail, its data could be rebuilt using the XOR results of the contents of the two remaining drives, Drive 1 and Drive 3:

| Drive 1: | 01101101 |

| Drive 3: | 10111001 |

as follows:

| 10111001 | |

| XOR | 01101101 |

| 11010100 |

The result of that XOR calculation yields Drive 2’s contents. 11010100 is then stored on Drive 2, fully repairing the array.

XOR logic is also equivalent to even parity (because a XOR b XOR c XOR … may be treated as XOR(a,b,c,…) which is an n-ary operator which is true if and only if an odd number of arguments are true). So the same XOR concept above applies similarly to larger RAID arrays with parity, using any number of disks. In the case of a RAID 3 array of 12 drives, 11 drives participate in the XOR calculation shown above and yield a value that is then stored on the dedicated parity drive.

Extensions and variations on the parity bit mechanism «double,» «dual,» or «diagonal» parity, are used in RAID-DP.

History[edit]

A parity track was present on the first magnetic tape data storage in 1951. Parity in this form, applied across multiple parallel signals, is known as a transverse redundancy check. This can be combined with parity computed over multiple bits sent on a single signal, a longitudinal redundancy check. In a parallel bus, there is one longitudinal redundancy check bit per parallel signal.

Parity was also used on at least some paper-tape (punched tape) data entry systems (which preceded magnetic tape systems). On the systems sold by British company ICL (formerly ICT) the 1-inch-wide (25 mm) paper tape had 8 hole positions running across it, with the 8th being for parity. 7 positions were used for the data, e.g., 7-bit ASCII. The 8th position had a hole punched in it depending on the number of data holes punched.

See also[edit]

- BIP-8

- Parity function

- Single-event upset

- 8-N-1

- Check digit

References[edit]

- ^ Ziemer, RodgerE.; Tranter, William H. (17 March 2014). Principles of communication : systems, modulation, and noise (Seventh ed.). Hoboken, New Jersey. ISBN 9781118078914. OCLC 856647730.

External links[edit]

- Different methods of generating the parity bit, among other bit operations

From Wikipedia, the free encyclopedia

| 7 bits of data | (count of 1-bits) | 8 bits including parity | |

|---|---|---|---|

| even | odd | ||

| 0000000 | 0 | 00000000 | 00000001 |

| 1010001 | 3 | 10100011 | 10100010 |

| 1101001 | 4 | 11010010 | 11010011 |

| 1111111 | 7 | 11111111 | 11111110 |

A parity bit, or check bit, is a bit added to a string of binary code. Parity bits are a simple form of error detecting code. Parity bits are generally applied to the smallest units of a communication protocol, typically 8-bit octets (bytes), although they can also be applied separately to an entire message string of bits.

The parity bit ensures that the total number of 1-bits in the string is even or odd.[1] Accordingly, there are two variants of parity bits: even parity bit and odd parity bit. In the case of even parity, for a given set of bits, the bits whose value is 1 are counted. If that count is odd, the parity bit value is set to 1, making the total count of occurrences of 1s in the whole set (including the parity bit) an even number. If the count of 1s in a given set of bits is already even, the parity bit’s value is 0. In the case of odd parity, the coding is reversed. For a given set of bits, if the count of bits with a value of 1 is even, the parity bit value is set to 1 making the total count of 1s in the whole set (including the parity bit) an odd number. If the count of bits with a value of 1 is odd, the count is already odd so the parity bit’s value is 0. Even parity is a special case of a cyclic redundancy check (CRC), where the 1-bit CRC is generated by the polynomial x+1.

Parity[edit]

In mathematics parity can refer to the evenness or oddness of an integer, which, when written in its binary form, can be determined just by examining only its least significant bit.

In information technology parity refers to the evenness or oddness, given any set of binary digits, of the number of those bits with value one. Because parity is determined by the state of every one of the bits, this property of parity—being dependent upon all the bits and changing its value from even to odd parity if any one bit changes—allows for its use in error detection and correction schemes.

In telecommunications the parity referred to by some protocols is for error-detection. The transmission medium is preset, at both end points, to agree on either odd parity or even parity. For each string of bits ready to transmit (data packet) the sender calculates its parity bit, zero or one, to make it conform to the agreed parity, even or odd. The receiver of that packet first checks that the parity of the packet as a whole is in accordance with the preset agreement, then, if there was a parity error in that packet, requests a re-transmission of that packet.

In computer science the parity stripe or parity disk in a RAID provides error-correction. Parity bits are written at the rate of one parity bit per n bits, where n is the number of disks in the array. When a read error occurs, each bit in the error region is recalculated from its set of n bits. In this way, using one parity bit creates «redundancy» for a region from the size of one bit to the size of one disk. See § Redundant Array of Independent Disks below.

In electronics, transcoding data with parity can be very efficient, as XOR gates output what is equivalent to a check bit that creates an even parity, and XOR logic design easily scales to any number of inputs. XOR and AND structures comprise the bulk of most integrated circuitry.

Error detection[edit]

If an odd number of bits (including the parity bit) are transmitted incorrectly, the parity bit will be incorrect, thus indicating that a parity error occurred in the transmission. The parity bit is only suitable for detecting errors; it cannot correct any errors, as there is no way to determine which particular bit is corrupted. The data must be discarded entirely, and re-transmitted from scratch. On a noisy transmission medium, successful transmission can therefore take a long time, or even never occur. However, parity has the advantage that it uses only a single bit and requires only a number of XOR gates to generate. See Hamming code for an example of an error-correcting code.

Parity bit checking is used occasionally for transmitting ASCII characters, which have 7 bits, leaving the 8th bit as a parity bit.

For example, the parity bit can be computed as follows. Assume Alice and Bob are communicating and Alice wants to send Bob the simple 4-bit message 1001.

| Type of bit parity | Successful transmission scenario |

|---|---|

| Even parity |

Alice wants to transmit: 1001 and 1011 Alice computes parity bit value: Alice adds parity bit and sends: Bob receives: 10010 and 10111 Bob computes parity: Bob reports correct transmission after observing expected even result. |

| Odd parity |

Alice wants to transmit: 1001 and 1011 Alice computes parity bit value: Alice adds parity bit and sends: Bob receives: 10011 and 10110 Bob computes overall parity: Bob reports correct transmission after observing expected odd result. |

This mechanism enables the detection of single bit errors, because if one bit gets flipped due to line noise, there will be an incorrect number of ones in the received data. In the two examples above, Bob’s calculated parity value matches the parity bit in its received value, indicating there are no single bit errors. Consider the following example with a transmission error in the second bit using XOR:

| Type of bit parity error | Failed transmission scenario |

|---|---|

| Even parity

Error in the second bit |

Alice wants to transmit: 1001

Alice computes parity bit value: 1^0^0^1 = 0 Alice adds parity bit and sends: 10010 …TRANSMISSION ERROR… Bob receives: 11010 Bob computes overall parity: 1^1^0^1^0 = 1 Bob reports incorrect transmission after observing unexpected odd result. |

| Even parity

Error in the parity bit |

Alice wants to transmit: 1001

Alice computes even parity value: 1^0^0^1 = 0 Alice sends: 10010 …TRANSMISSION ERROR… Bob receives: 10011 Bob computes overall parity: 1^0^0^1^1 = 1 Bob reports incorrect transmission after observing unexpected odd result. |

There is a limitation to parity schemes. A parity bit is only guaranteed to detect an odd number of bit errors. If an even number of bits have errors, the parity bit records the correct number of ones, even though the data is corrupt. (See also Error detection and correction.) Consider the same example as before with an even number of corrupted bits:

| Type of bit parity error | Failed transmission scenario |

|---|---|

| Even parity

Two corrupted bits |

Alice wants to transmit: 1001

Alice computes even parity value: 1^0^0^1 = 0 Alice sends: 10010 …TRANSMISSION ERROR… Bob receives: 11011 Bob computes overall parity: 1^1^0^1^1 = 0 Bob reports correct transmission though actually incorrect. |

Bob observes even parity, as expected, thereby failing to catch the two bit errors.

Usage[edit]

Because of its simplicity, parity is used in many hardware applications where an operation can be repeated in case of difficulty, or where simply detecting the error is helpful. For example, the SCSI and PCI buses use parity to detect transmission errors, and many microprocessor instruction caches include parity protection. Because the I-cache data is just a copy of main memory, it can be disregarded and re-fetched if it is found to be corrupted.

In serial data transmission, a common format is 7 data bits, an even parity bit, and one or two stop bits. This format accommodates all the 7-bit ASCII characters in an 8-bit byte. Other formats are possible; 8 bits of data plus a parity bit can convey all 8-bit byte values.

In serial communication contexts, parity is usually generated and checked by interface hardware (e.g., a UART) and, on reception, the result made available to a processor such as the CPU (and so too, for instance, the operating system) via a status bit in a hardware register in the interface hardware. Recovery from the error is usually done by retransmitting the data, the details of which are usually handled by software (e.g., the operating system I/O routines).

When the total number of transmitted bits, including the parity bit, is even, odd parity has the advantage that the all-zeros and all-ones patterns are both detected as errors. If the total number of bits is odd, only one of the patterns is detected as an error, and the choice can be made based on which is expected to be the more common error.

RAID array[edit]

Parity data is used by RAID arrays (redundant array of independent/inexpensive disks) to achieve redundancy. If a drive in the array fails, remaining data on the other drives can be combined with the parity data (using the Boolean XOR function) to reconstruct the missing data.

For example, suppose two drives in a three-drive RAID 5 array contained the following data:

| Drive 1: | 01101101 |

| Drive 2: | 11010100 |

To calculate parity data for the two drives, an XOR is performed on their data:

| 01101101 | |

| XOR | 11010100 |

| 10111001 |

The resulting parity data, 10111001, is then stored on Drive 3.

Should any of the three drives fail, the contents of the failed drive can be reconstructed on a replacement drive by subjecting the data from the remaining drives to the same XOR operation. If Drive 2 were to fail, its data could be rebuilt using the XOR results of the contents of the two remaining drives, Drive 1 and Drive 3:

| Drive 1: | 01101101 |

| Drive 3: | 10111001 |

as follows:

| 10111001 | |

| XOR | 01101101 |

| 11010100 |

The result of that XOR calculation yields Drive 2’s contents. 11010100 is then stored on Drive 2, fully repairing the array.

XOR logic is also equivalent to even parity (because a XOR b XOR c XOR … may be treated as XOR(a,b,c,…) which is an n-ary operator which is true if and only if an odd number of arguments are true). So the same XOR concept above applies similarly to larger RAID arrays with parity, using any number of disks. In the case of a RAID 3 array of 12 drives, 11 drives participate in the XOR calculation shown above and yield a value that is then stored on the dedicated parity drive.

Extensions and variations on the parity bit mechanism «double,» «dual,» or «diagonal» parity, are used in RAID-DP.

History[edit]

A parity track was present on the first magnetic tape data storage in 1951. Parity in this form, applied across multiple parallel signals, is known as a transverse redundancy check. This can be combined with parity computed over multiple bits sent on a single signal, a longitudinal redundancy check. In a parallel bus, there is one longitudinal redundancy check bit per parallel signal.

Parity was also used on at least some paper-tape (punched tape) data entry systems (which preceded magnetic tape systems). On the systems sold by British company ICL (formerly ICT) the 1-inch-wide (25 mm) paper tape had 8 hole positions running across it, with the 8th being for parity. 7 positions were used for the data, e.g., 7-bit ASCII. The 8th position had a hole punched in it depending on the number of data holes punched.

See also[edit]

- BIP-8

- Parity function

- Single-event upset

- 8-N-1

- Check digit

References[edit]

- ^ Ziemer, RodgerE.; Tranter, William H. (17 March 2014). Principles of communication : systems, modulation, and noise (Seventh ed.). Hoboken, New Jersey. ISBN 9781118078914. OCLC 856647730.

External links[edit]

- Different methods of generating the parity bit, among other bit operations

Подборка по базе: Форма_ Приказ об утверждении положения о персональных данных (1), Форма_ Положение (политика) о персональных данных работников.rtf, Лабораторная работа № 3 «Создание форм в СУБД MS Access» по ди, Лабораторная работа № 2 по дисциплине- «Базы данных» .docx, Лабораторная работа № 1 по дисциплине- «Базы данных» .docx, Форма_ Лист ознакомления с положением о персональных данных.rtf, Алгоритмы и структуры данных.docx, Конспект урока_ _Трансформатор. Производство и передача электроэ, Базы данных.pdf, ПРАКТИЧЕСКАЯ РАБОТА № 3 Основные типы и форматы данных в электро

п 2 Передача данных

Харлова алина 11А

вопросы

1

2

3

4

5

6

7

8

9

выход

в1 Почему для любого канала связи скорость передачи данных ограничена?

Пропускная способность любого канала связи, в котором есть помехи, ограничена. Это значит, что есть некоторая наибольшая возможная скорость передачи данных, которую принципиально невозможно превысить. Зависит от аппаратуры и мощности помех. Не может быть больше скорости света.

назад

теория

в2 В каких случаях при передаче информации допустимы незначительные ошибки?

В реальных каналах связи всегда присутствуют помехи, искажающие сигнал. В некоторых случаях ошибки допустимы, например, при прослушивании радиопередачи через Интернет небольшое искажение звука не мешает понимать речь.

назад

теория

В3 что такое избыточность сообщения? Для чего ее можно использовать?

Избыточность – это превышение количества информации, используемой для передачи или хранения сообщения. приводит к увеличению времени передачи сообщений, уменьшению скорости передачи информации, излишней загрузки канала, вместе с тем, избыточность необходима для обеспечения достоверности передаваемых данных. Применяя специальные коды, использующие избыточность в передаваемых сообщениях, можно обнаружить и исправить ошибки.

назад

теория

В4 в каких случаях с помощью бита четности можно обнаружить ошибку, а в каких – нельзя?

Бит чётности позволяет обнаруживать нечётное число ошибок (1, 3, 5, …), а ошибки в чётном количестве разрядов остаются незамеченными. Контроль применяется для небольших блоков данных (чаще всего — для каждого отдельного байта) и хорошо работает тогда, когда отдельные ошибки при передаче независимы одна от другой и встречаются редко.

назад

теория

В5 можно ли исправить ошибку, обнаружив неверное значение бита четности?

Исправить ошибку нельзя, потому что непонятно, в каком именно разряде она случилась. Если же изменилось два бита, чётность не меняется, и такая ошибка не обнаруживается.

назад

теория

В6 как вы думаете, почему для контроля передачи файлов используются контрольные суммы, а не бит четности?

Используя бит четности, легко и быстро работать, но если произошло более одной ошибки, то ее можно не заметить. Используя контрольные суммы каждая ошибка будет обнаружена, но при передаче и получении нужно будет вычислять эту контрольную сумму, что приведет к временным затратам.

назад

теория

В7 каково должно быть расстояние хэмминга между двумя любыми кодами, чтобы можно было исправить 2 ошибки?

Минимальное расстояние Хэмминга выбирается из условия расстояние равно d . Условие d>= 2r+1 , где r кол-во ошибок. Поэтому d>=5, может либо исправлять однократные ошибки, либо только обнаруживать однократные и двукратные ошибки.

назад

теория

В8 как исправляется ошибка при использовании помехоустойчивого кода?

Для исправления ошибки нужно к символу разряда в котором произошла ошибка прибавить единицу по модулю два.

назад

теория

В9 какие достоинства и недостатки есть у кодов хэмминга с большим размером блоков?

Недостаток кода Хэмминга — некратность размера исходного блока кода и блока кода степени двойки. Это затрудняет обработку кодов Хэмминга на компьютерах, оперирующих блоками бит кратными степени двойки. Достоинство в том, что реализация алгоритма требует небольших ресурсов и может быть выполнена аппаратно. Исходными данными для кодирования является произвольная двоичная последовательность.

назад

теория

1 доп Теория

- Скорость передачи данных – это кол-во бит, которое передается по каналу связи за единицу времени.

- Пропускная способность канала связи – наибольшая возможная скорость передачи данных, которую принципиально невозможно превысить.

- Объем информации вычисляется по формуле I = u * t

назад

2 доп теория

Избыточность – включать в код « лишние биты », только для того чтобы найти ошибку.

Бит четности – дополнительный бит, используется при передачи данных в сетях. Ставится в конце блока данных, будет равен 1, если в основном сообщении нечетное число единиц, и равен 0, если сообщение с четным числом единиц. Применяется для небольших блоков данных. Контрольная сумма – другой метод обнаружения ошибок. Применяются алгоритмы CRC, хэш-функции. Если конт. сумма не совпадает то произошла ошибка.

назад

3 доп теория

- Помехоустойчивый код – код, который позволяет исправлять ошибки, если их кол-во не превышает некоторого уровня.

- Расстояние Хэмминга – кол-во позиций, в которых различаются два закодированных сообщения одинаковой длины.

- Код Хэмминга — самоконтролирующийся и самокорректирующийся код. Построен применительно к двоичной системе счисления. Позволяет исправлять одиночную ошибку и находить двойную.

…

Мы знаем, что биты 0 и 1 соответствуют двум разным диапазонам аналоговых напряжений. Таким образом, во время передачи двоичных данных из одной системы в другую, шум также может быть добавлен. Из-за этого могут быть ошибки в полученных данных в другой системе.

Это означает, что бит 0 может измениться на 1 или бит 1 может измениться на 0. Мы не можем избежать помех от шума. Но мы можем сначала получить исходные данные, обнаружив, присутствуют ли какие-либо ошибки, а затем исправив эти ошибки. Для этой цели мы можем использовать следующие коды.

- Коды обнаружения ошибок

- Коды исправления ошибок

Коды обнаружения ошибок – используются для обнаружения ошибок, присутствующих в принятых данных (битовом потоке). Эти коды содержат некоторые биты, которые включены (добавлены) в исходный поток битов. Эти коды обнаруживают ошибку, если она произошла во время передачи исходных данных (потока битов). Пример – код четности, код Хэмминга.

Коды исправления ошибок – используются для исправления ошибок, присутствующих в полученных данных (битовом потоке), чтобы мы получили исходные данные. Коды исправления ошибок также используют аналогичную стратегию кодов обнаружения ошибок. Пример – код Хэмминга.

Поэтому, чтобы обнаружить и исправить ошибки, дополнительные биты добавляются к битам данных во время передачи.

Код паритета

Легко включить (добавить) один бит четности либо слева от MSB, либо справа от LSB исходного битового потока. Существует два типа кодов четности, а именно четный код четности и нечетный код четности, в зависимости от типа выбранной четности.

Четный код

Значение четного бита должно быть равно нулю, если в двоичном коде присутствует четное количество единиц. В противном случае он должен быть один. Таким образом, четное число единиц присутствует в четном коде четности . Четный код четности содержит биты данных и четный бит четности.

В следующей таблице приведены коды четности, соответствующие каждому 3-битному двоичному коду. Здесь бит четности включен справа от LSB двоичного кода.

| Бинарный код | Четный бит | Четный код |

|---|---|---|

| 000 | 0 | 0000 |

| 001 | 1 | 0011 |

| 010 | 1 | 0101 |

| 011 | 0 | 0110 |

| 100 | 1 | 1001 |

| 101 | 0 | 1010 |

| 110 | 0 | 1100 |

| 111 | 1 | 1111 |

Здесь число битов, присутствующих в четных кодах четности, равно 4. Таким образом, возможное четное число единиц в этих четных кодах четности равно 0, 2 и 4.

-

Если другая система получает один из этих четных кодов четности, то в полученных данных нет ошибки. Биты, отличные от четного бита, совпадают с битами двоичного кода.

-

Если другая система получит коды, отличные от четных, то в полученных данных возникнет ошибка (и). В этом случае мы не можем предсказать исходный двоичный код, потому что мы не знаем битовую позицию (ы) ошибки.

Если другая система получает один из этих четных кодов четности, то в полученных данных нет ошибки. Биты, отличные от четного бита, совпадают с битами двоичного кода.

Если другая система получит коды, отличные от четных, то в полученных данных возникнет ошибка (и). В этом случае мы не можем предсказать исходный двоичный код, потому что мы не знаем битовую позицию (ы) ошибки.

Поэтому четный бит четности полезен только для обнаружения ошибки в принятом коде четности. Но недостаточно исправить ошибку.

Код нечетного паритета

Значение нечетного бита четности должно быть нулевым, если в двоичном коде присутствует нечетное число единиц. В противном случае, он должен быть один. Так что нечетное количество единиц присутствует в нечетном коде четности . Нечетный код четности содержит биты данных и нечетный бит четности.

В следующей таблице показаны нечетные коды четности, соответствующие каждому 3-битному двоичному коду. Здесь нечетный бит четности включен справа от LSB двоичного кода.

| Бинарный код | Нечетный бит четности | Код нечетного паритета |

|---|---|---|

| 000 | 1 | 0001 |

| 001 | 0 | 0010 |

| 010 | 0 | 0100 |

| 011 | 1 | 0111 |

| 100 | 0 | 1000 |

| 101 | 1 | 1011 |

| 110 | 1 | 1101 |

| 111 | 0 | 1110 |

Здесь число битов, присутствующих в нечетных кодах четности, равно 4. Таким образом, возможное нечетное число единиц в этих нечетных кодах четности равно 1 и 3.

-

Если другая система получает один из этих нечетных кодов четности, то в полученных данных нет ошибки. Биты, отличные от нечетного бита четности, совпадают с битами двоичного кода.

-

Если другая система получает не четные коды четности, то в полученных данных есть ошибка (и). В этом случае мы не можем предсказать исходный двоичный код, потому что мы не знаем битовую позицию (ы) ошибки.

Если другая система получает один из этих нечетных кодов четности, то в полученных данных нет ошибки. Биты, отличные от нечетного бита четности, совпадают с битами двоичного кода.

Если другая система получает не четные коды четности, то в полученных данных есть ошибка (и). В этом случае мы не можем предсказать исходный двоичный код, потому что мы не знаем битовую позицию (ы) ошибки.

Следовательно, нечетный бит четности полезен только для обнаружения ошибки в принятом коде четности. Но недостаточно исправить ошибку.

Код Хэмминга

Код Хэмминга полезен как для обнаружения, так и для исправления ошибок, присутствующих в полученных данных. Этот код использует несколько битов четности, и мы должны поместить эти биты четности в позиции степеней 2.

Минимальное значение «k», для которого следующее соотношение является правильным (действительным), является не чем иным, как требуемым количеством битов четности.

2k geqn+k+1

Куда,

«n» – количество бит в двоичном коде (информация)

‘k’ – количество бит четности

Следовательно, количество битов в коде Хэмминга равно n + k.

Пусть код Хэмминга равен bn+kbn+k−1.....b3b2b1 и битам четности pk,pk−1,....p1. Мы можем поместить биты четности ‘k’ только в степени 2 позиции. В оставшихся битовых позициях мы можем разместить n бит двоичного кода.

Исходя из требований, мы можем использовать четную или нечетную четность при формировании кода Хемминга. Но тот же метод контроля четности следует использовать для того, чтобы определить, присутствует ли какая-либо ошибка в полученных данных.

Выполните эту процедуру для поиска битов четности .

-

Найдите значение p 1 , основанное на количестве единиц, присутствующих в позициях битов b 3 , b 5 , b 7 и так далее. Все эти битовые позиции (суффиксы) в их эквивалентном двоичном файле имеют «1» в значении места 2 0 .

-

Найдите значение p 2 , основанное на количестве единиц, присутствующих в позициях битов b 3 , b 6 , b 7 и так далее. Все эти битовые позиции (суффиксы) в их эквивалентном двоичном файле имеют «1» в значении места 2 1 .

-

Найдите значение p 3 , основанное на количестве единиц, присутствующих в позициях битов b 5 , b 6 , b 7 и так далее. Все эти битовые позиции (суффиксы) в их эквивалентном двоичном файле имеют «1» в значении места 2 2 .

-

Аналогично найдите другие значения битов четности.

Найдите значение p 1 , основанное на количестве единиц, присутствующих в позициях битов b 3 , b 5 , b 7 и так далее. Все эти битовые позиции (суффиксы) в их эквивалентном двоичном файле имеют «1» в значении места 2 0 .

Найдите значение p 2 , основанное на количестве единиц, присутствующих в позициях битов b 3 , b 6 , b 7 и так далее. Все эти битовые позиции (суффиксы) в их эквивалентном двоичном файле имеют «1» в значении места 2 1 .

Найдите значение p 3 , основанное на количестве единиц, присутствующих в позициях битов b 5 , b 6 , b 7 и так далее. Все эти битовые позиции (суффиксы) в их эквивалентном двоичном файле имеют «1» в значении места 2 2 .

Аналогично найдите другие значения битов четности.

Выполните эту процедуру для поиска контрольных битов .

-

Найдите значение c 1 , основанное на количестве единиц, присутствующих в битовых позициях b 1 , b 3 , b 5 , b 7 и так далее. Все эти битовые позиции (суффиксы) в их эквивалентном двоичном файле имеют «1» в значении места 2 0 .

-

Найдите значение c 2 , основанное на количестве единиц, присутствующих в позициях битов b 2 , b 3 , b 6 , b 7 и так далее. Все эти битовые позиции (суффиксы) в их эквивалентном двоичном файле имеют «1» в значении места 2 1 .

-

Найдите значение c 3 , основанное на количестве единиц, присутствующих в позициях битов b 4 , b 5 , b 6 , b 7 и так далее. Все эти битовые позиции (суффиксы) в их эквивалентном двоичном файле имеют «1» в значении места 2 2 .

-

Аналогично найдите другие значения контрольных битов.

Найдите значение c 1 , основанное на количестве единиц, присутствующих в битовых позициях b 1 , b 3 , b 5 , b 7 и так далее. Все эти битовые позиции (суффиксы) в их эквивалентном двоичном файле имеют «1» в значении места 2 0 .

Найдите значение c 2 , основанное на количестве единиц, присутствующих в позициях битов b 2 , b 3 , b 6 , b 7 и так далее. Все эти битовые позиции (суффиксы) в их эквивалентном двоичном файле имеют «1» в значении места 2 1 .

Найдите значение c 3 , основанное на количестве единиц, присутствующих в позициях битов b 4 , b 5 , b 6 , b 7 и так далее. Все эти битовые позиции (суффиксы) в их эквивалентном двоичном файле имеют «1» в значении места 2 2 .

Аналогично найдите другие значения контрольных битов.

Десятичный эквивалент контрольных битов в полученных данных дает значение позиции бита, где присутствует ошибка. Просто добавьте значение, присутствующее в этой позиции бита. Поэтому мы получим оригинальный двоичный код после удаления битов четности.

Пример 1

Найдем код Хемминга для двоичного кода: d 4 d 3 d 2 d 1 = 1000. Рассмотрим четные биты четности.

Количество битов в данном двоичном коде равно n = 4.

Мы можем найти необходимое количество бит четности, используя следующее математическое соотношение.

2k geqn+k+1

Подставим n = 4 в вышеприведенном математическом соотношении.

Rightarrow2k geq4+k+1

Rightarrow2k geq5+k

Минимальное значение k, удовлетворяющее указанному выше соотношению, равно 3. Следовательно, нам требуется 3 бита четности p 1 , p 2 и p 3 . Следовательно, количество битов в коде Хэмминга будет равно 7, поскольку в двоичном коде 4 бита и 3 бита четности. Мы должны поместить биты четности и биты двоичного кода в код Хэмминга, как показано ниже.

7-битный код Хэмминга : b7b6b5b4b3b2b1=d4d3d2p3D1р−2bp1

Подставляя биты двоичного кода, код Хэмминга будет b7b6b5b4b3b2b1=100p3Op2p1. Теперь давайте найдем биты четности.

p1=b7 oplusb5 oplusb3=1 oplus0 oplus0=1

p2=b7 oplusb6 oplusb3=1 oplus0 oplus0=1

p3=b7 oplusb6 oplusb5=1 oplus0 oplus0=1

Подставляя эти биты четности, код Хэмминга будет иметь значение b7b6b5b4b3b2b1=1001011.

Пример 2

В приведенном выше примере мы получили код Хэмминга в виде b7b6b5b4b3b2b1=1001011. Теперь давайте найдем позицию ошибки, когда полученный код равен b7b6b5b4b3b2b1=1001111.

Теперь давайте найдем контрольные биты.

c1=b7 oplusb5 oplusb3 oplusb1=1 oplus0 oplus1 oplus1=1

c2=b7 oplusb6 oplusb3 oplusb2=1 oplus0 oplus1 oplus1=1

c3=b7 oplusb6 oplusb5 oplusb4=1 oplus0 oplus0 oplus1=0

Десятичное значение контрольных битов дает позицию ошибки в полученном коде Хэмминга.

c3c2c1= left(011 right)2= left(3 right)10

Следовательно, ошибка присутствует в третьем бите (b 3 ) кода Хэмминга. Просто добавьте значение, присутствующее в этом бите, и удалите биты четности, чтобы получить исходный двоичный код.

См.

в лекциях Эллины

11. Контроль четности. Двумерный контроль четности

Возможно, простейшая форма обнаружения

ошибок заключается в использовании

одного бита четности. Предположим, что

на рис. 5.4 передаваемые данные D имеют

длину d разрядов. При проверке на четность

отправитель просто добавляет к данным

один бит, значение которого вычисляется

как сумма всех d разрядов данных по

модулю 2. В этом случае количество единиц

в получающемся в результате числе всегда

будет четным. Применяются также схемы,

в которых контрольный бит инвертируется,

в результате чего количество единиц в

получающемся в результате числе всегда

будет нечетным. На рис. 5.5 изображена

схема проверки на четность, а единственный

бит четности хранится в отдельном поле.

Действия, выполняемые получателем

при использовании такой схемы, также

очень просты. Получатель должен всего

лишь сосчитать количество единиц в

полученных d + 1 разрядах. Если при проверке

на четность получатель обнаруживает,

что в принятых им данных нечетное

количество единичных разрядов, он

понимает, что произошла ошибка, по

меньшей мере, в одном разряде. В общем

случае это означает, что в полученных

данных инвертировано нечетное количество

разрядов (произошла ошибка нечетной

кратности).

Что произойдет, если в полученном

пакете данных произойдет четное

количество однобитовых ошибок? В этом

случае получатель не сможет обнаружить

ошибку. Если вероятность ошибки в одном

разряде мала и можно предположить, что

ошибки в отдельных разрядах возникают

независимо друг от друга, тогда вероятность

нескольких ошибок в одном пакете крайне

мала. В таком случае единственного бита

четности может быть достаточно. Однако

практические наблюдения показали, что

в действительности ошибки не являются

независимыми, а часто группируются в

пакеты ошибок. В случае пакетных ошибок

вероятность того, что получатель не

обнаружит ошибку в пакете, может

приблизиться к величине 50 %. Очевидно,

в такой ситуации требуется более надежная

схема обнаружения ошибок! Но прежде чем

перейти к изучению схем обнаружения

ошибок, применяемых на практике,

рассмотрим простую схему, которая

обобщает предыдущую схему одноразрядного

контроля четности и помогает понять

принцип работы методов исправления

ошибок.

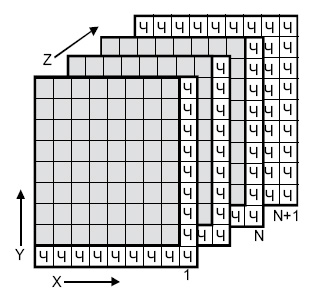

На рис. 5.6 показано двухмерное обобщение

одноразрядной схемы проверки на четность.

В данной схеме d разрядов пакета данных

разделяются на г строк и j столбцов,

образуя прямоугольную матрицу. Значение

четности вычисляется для каждой строки

и каждого столбца. Получающиеся в

результате i +j +1 битов четности образуют

разряды обнаружения ошибок кадра

канального уровня.

Предположим теперь, что в исходном

блоке данных из d разрядов происходит

однократная ошибка. В такой двухмерной

схеме контроля четности об ошибке будут

одновременно сигнализировать контрольные

разряды строки и столбца. Таким образом,

получатель сможет не только обнаружить

сам факт ошибки, но и по номерам строки

и столбца найти поврежденный бит данных

и исправить его! На рисунке показан

пример, в котором поврежден бит в позиции

(2, 2) — он изменил свое значение с 1 на 0.

Такую одиночную ошибку получатель может

не только обнаружить, но и исправить.

Хотя нас, в первую очередь, интересует

обнаружение и исправление ошибок в

исходных d разрядах, данная схема

позволяет также обнаруживать и исправлять

одиночные ошибки в самих битах четности.

Кроме того, данная двухмерная схема

контроля четности позволяет обнаруживать

(но не исправлять!) любые комбинации из

двух одиночных ошибок (то есть двойные

ошибки) в пакете.

Способность приемника обнаруживать

и исправлять ошибки иногда называют

прямым исправлением ошибок (Forward Error

Correction, FEC). Подобные приемы широко

применяются в устройствах хранения и

воспроизведения звука, например на

лазерных компакт-дисках. В сетях методы

обнаружения и исправления ошибок могут

использоваться сами по себе, а также в

сочетании с автоматическими запросами

на повторную передачу. Методы обнаружения

и исправления ошибок очень полезны так

как позволяют снизить необходимое

количество повторных передач. Кроме

того (что, возможно, даже важнее), эти

методы позволяют получателю немедленно

исправлять ошибки. Таким образом,

получатель данных может не ждать, пока

отправитель получит его сообщение об

ошибке и вышлет пакет еще раз, что может

быть существенным преимуществом в

сетевых приложениях реального времени.

Соседние файлы в предмете [НЕСОРТИРОВАННОЕ]

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

Скачать материал

Скачать материал

- Сейчас обучается 109 человек из 38 регионов

- Курс добавлен 19.01.2023

- Сейчас обучается 30 человек из 18 регионов

Описание презентации по отдельным слайдам:

-

1 слайд

Передача информации

-

2 слайд

Отправитель информации

Получатель информации

Канал передачи информации

Канал обмена информацией

Основной характеристикой каналов передачи информации является их пропускная способность, или скорость передачи информации.

Пропускная способность равна количеству информации, которое может передаваться по каналу за единицу времени.

Пропускная способность измеряется в битах в секунду (бит/с) и кратных единицах Кбит/с, Мбит/с. -

3 слайд

Соотношения между единицами пропускной способности

-

4 слайд

Скорость передачи данных

Для любого канала связи, в котором есть помехи, пропускная способность ограничена. Это значит, что есть некоторая наибольшая возможная скорость передачи данных, которую принципиально невозможно превысить.

Объем информации I, переданной по каналу за время t, вычисляется по формуле I = v·t, где v — скорость передачи информации. Например, если скорость передачи данных равна 512 000 бит/c, за 1 минуту можно передать файл объемом

512 000 бит/с х 60 c = 30 720 000 бит = 3 840 000 байт = 3075 Кбайт 3 Мбайт. -

5 слайд

Ошибки в передаче данных

В реальных каналах связи всегда присутствуют помехи, искажающие сигнал. В некоторых случаях ошибки допустимы, например, при прослушивании радиопередачи через Интернет небольшое искажение звука не мешает понимать речь.

Получена цепочка нулей и единиц

1010101110 -

6 слайд

Бит четности

Простейший вариант организации помехоустойчивого канала связи – это добавить один бит в конце блока данных, который будет равен 1, если в основном сообщении нечетное число единиц, и равен 0 для сообщения с четным числом единиц. Этот дополнительный бит называется битом четности. -

7 слайд

Например:

Требуется передать два бита данных. Возможно всего 4 разных сообщения:

00, 01, 10 и 11.

Первое и четвертое из них содержат четное число единиц (0 и 2), значит, бит четности для них равен 0. Во втором и третьем сообщениях нечетное число единиц (1), поэтому бит четности будет равен 1. Таким образом, сообщения с добавленным битом четности будут выглядеть так:

000, 011, 101, 110

000, 011, 101, 110

Первые два бита несут полезную информацию, а третий – вспомогательный, он служит только для обнаружения ошибки. Обратим внимание, что каждое из этих сообщений содержит четное число единиц. -

8 слайд

Метод контрольной суммы

метод контрольной суммы (англ. CRC = Cyclic Redundancy Check – проверка с помощью циклических сумм). Если контрольная сумма блока данных, вычисленная приемником по специальному довольно сложному алгоритму, не совпадает с контрольной суммой, записанной передающей стороной, произошла ошибка. -

9 слайд

Помехоустойчивые коды

Для повышения помехоустойчивости передачи данных следует настолько увеличить избыточность кода (добавить «лишние» биты), что небольшое число ошибок все равно позволяет достаточно уверенно распознать переданное сообщение. -

10 слайд

Например:

Например, пусть нужно передать один бит, 0 или 1. Утроим его, добавив еще два бита, совпадающих с первым. Таким образом, получается два «правильных» сообщения:

000 и 111.

Теперь посмотрим, что получится, если при передаче одного из битов сообщения 000 произошла ошибка, и приемник получил искаженное сообщение 001. Заметим, что оно отличается одним битом от 000, и двумя битами от второго возможного варианта — 111. Значит, скорее всего, произошла ошибка в последнем бите и сообщение нужно исправить на 000. Если приемник получил 101, можно точно сказать, что произошла ошибка, однако попытка исправить ее приведет к неверному варианту, так как ближайшая «правильная» последовательность — это 111. Таким образом, такой код обнаруживает одну или две ошибки. Кроме того, он позволяет исправить (!) одну ошибку, то есть является помехоустойчивым.

Помехоустойчивый код — это код, который позволяет исправлять ошибки, если их количество не превышает некоторого уровня. -

11 слайд

?

В чем можно измерять скорость передачи информации?

Почему для любого канала связи скорость передачи данных ограничена?

Как вычисляется объем информации, который можно передать за некоторое время?

В каких случаях при передаче информации допустимы незначительные ошибки?

Что такое избыточность сообщения? Для чего ее можно использовать?

Как помехи влияют на передачу информации?

Что такое бит четности? В каких случаях с помощью бита четности можно обнаружить ошибку, а в каких – нельзя?

Можно ли исправить ошибку, обнаружив неверное значение бита четности?

Для чего используется метод вычисления контрольной суммы?

Какой код называют помехоустойчивым? -

12 слайд

Задача

Определите максимальный размер файла в Кбайтах, который может быть передан за 10 минут со скоростью 32 килобита/с.

У Васи есть доступ к Интернет по высокоскоростному одностороннему радиоканалу, обеспечивающему скорость получения им информации 256 Кбит/с. У Пети нет скоростного доступа в Интернет, но есть возможность получать информацию от Васи по низкоскоростному телефонному каналу со средней скоростью 32 Кбит/с. Петя договорился с Васей, что тот будет скачивать для него данные объемом 5 Мбайт по высокоскоростному каналу и ретранслировать их Пете по низкоскоростному каналу. Компьютер Васи может начать ретрансляцию данных не раньше, чем им будут получены первые 512 Кбайт этих данных. Каков минимально возможный промежуток времени (в секундах), с момента начала скачивания Васей данных, до полного их получения Петей?

Найдите материал к любому уроку, указав свой предмет (категорию), класс, учебник и тему:

6 116 903 материала в базе

- Выберите категорию:

- Выберите учебник и тему

- Выберите класс:

-

Тип материала:

-

Все материалы

-

Статьи

-

Научные работы

-

Видеоуроки

-

Презентации

-

Конспекты

-

Тесты

-

Рабочие программы

-

Другие методич. материалы

-

Найти материалы

Другие материалы

- 26.02.2017

- 368

- 0

- 26.02.2017

- 1631

- 3

- 26.02.2017

- 527

- 0

- 26.02.2017

- 660

- 2

- 26.02.2017

- 453

- 0

- 26.02.2017

- 706

- 1

Рейтинг:

5 из 5

- 26.02.2017

- 722

- 1

Вам будут интересны эти курсы:

-

Курс повышения квалификации «Внедрение системы компьютерной математики в процесс обучения математике в старших классах в рамках реализации ФГОС»

-

Курс повышения квалификации «Облачные технологии в образовании»

-

Курс профессиональной переподготовки «Информационные технологии в профессиональной деятельности: теория и методика преподавания в образовательной организации»

-

Курс повышения квалификации «Использование компьютерных технологий в процессе обучения в условиях реализации ФГОС»

-

Курс повышения квалификации «Применение MS Word, Excel в финансовых расчетах»

-

Курс профессиональной переподготовки «Управление в сфере информационных технологий в образовательной организации»

-

Курс профессиональной переподготовки «Математика и информатика: теория и методика преподавания в образовательной организации»

-

Курс повышения квалификации «Современные тенденции цифровизации образования»

-

Курс повышения квалификации «Специфика преподавания дисциплины «Информационные технологии» в условиях реализации ФГОС СПО по ТОП-50»

-

Курс повышения квалификации «Применение интерактивных образовательных платформ на примере платформы Moodle»

Аннотация: Контроль по четности, CRC, алгоритм Хэмминга. Введение в коды Рида-Соломона: принципы, архитектура и реализация. Метод коррекции ошибок FEC (Forward Error Correction).

Каналы передачи данных ненадежны (шумы, наводки и т.д.), да и само оборудование обработки информации работает со сбоями. По этой причине важную роль приобретают механизмы детектирования ошибок. Ведь если ошибка обнаружена, можно осуществить повторную передачу данных и решить проблему. Если исходный код по своей длине равен полученному коду, обнаружить ошибку передачи не предоставляется возможным. Можно, конечно, передать код дважды и сравнить, но это уже двойная избыточность.

Простейшим способом обнаружения ошибок является контроль по четности. Обычно контролируется передача блока данных ( М бит). Этому блоку ставится в соответствие кодовое слово длиной N бит, причем N>M. Избыточность кода характеризуется величиной 1-M/N. Вероятность обнаружения ошибки определяется отношением M/N (чем меньше это отношение, тем выше вероятность обнаружения ошибки, но и выше избыточность).

При передаче информации она кодируется таким образом, чтобы с одной стороны характеризовать ее минимальным числом символов, а с другой – минимизировать вероятность ошибки при декодировании получателем. Для выбора типа кодирования важную роль играет так называемое расстояние Хэмминга.

Пусть А и Б — две двоичные кодовые последовательности равной длины. Расстояние Хэмминга между двумя этими кодовыми последовательностями равно числу символов, которыми они отличаются. Например, расстояние Хэмминга между кодами 00111 и 10101 равно 2.

Можно показать, что для детектирования ошибок в n битах схема кодирования требует применения кодовых слов с расстоянием Хэмминга не менее N + 1. Можно также показать, что для исправления ошибок в N битах необходима схема кодирования с расстоянием Хэмминга между кодами не менее 2N + 1. Таким образом, конструируя код, мы пытаемся обеспечить расстояние Хэмминга между возможными кодовыми последовательностями большее, чем оно может возникнуть из-за ошибок.

Широко распространены коды с одиночным битом четности. В этих кодах к каждым М бит добавляется 1 бит, значение которого определяется четностью (или нечетностью) суммы этих М бит. Так, например, для двухбитовых кодов 00, 01, 10, 11 кодами с контролем четности будут 000, 011, 101 и 110. Если в процессе передачи один бит будет передан неверно, четность кода из М+1 бита изменится.

Предположим, что частота ошибок ( BER – Bit Error Rate) равна р = 10-4. В этом случае вероятность передачи 8 бит с ошибкой составит 1 – (1 – p)8 = 7,9 х 10-4. Добавление бита четности позволяет детектировать любую ошибку в одном из переданных битах. Здесь вероятность ошибки в одном из 9 битов равна 9p(1 – p)8. Вероятность же реализации необнаруженной ошибки составит 1 – (1 – p)9 – 9p(1 – p)8 = 3,6 x 10-7. Таким образом, добавление бита четности уменьшает вероятность необнаруженной ошибки почти в 1000 раз. Использование одного бита четности типично для асинхронного метода передачи. В синхронных каналах чаще используется вычисление и передача битов четности как

для строк, так и для столбцов передаваемого массива данных. Такая схема позволяет не только регистрировать, но и исправлять ошибки в одном из битов переданного блока.

Контроль по четности достаточно эффективен для выявления одиночных и множественных ошибок в условиях, когда они являются независимыми. При возникновении ошибок в кластерах бит метод контроля четности неэффективен, и тогда предпочтительнее метод вычисления циклических сумм ( CRC — Cyclic Redundancy Check). В этом методе передаваемый кадр делится на специально подобранный образующий полином. Дополнение остатка от деления и является контрольной суммой.

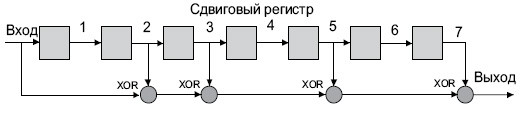

В Ethernet вычисление CRC производится аппаратно. На

рис.

4.1 показан пример реализации аппаратного расчета CRC для образующего полинома R(x) = 1 + x2 + x3 + x5 + x7. В этой схеме входной код приходит слева.

Рис.

4.1.

Схема реализации расчета CRC

Эффективность CRC для обнаружения ошибок на многие порядки выше простого контроля четности. В настоящее время стандартизовано несколько типов образующих полиномов. Для оценочных целей можно считать, что вероятность невыявления ошибки в случае использования CRC, если ошибка на самом деле имеет место, равна (1/2)r, где r — степень образующего полинома.

| CRC -12 | x12 + x11 + x3 + x2 + x1 + 1 |

| CRC -16 | x16 + x15 + x2 + 1 |

| CRC -CCITT | x16 + x12 + x5 + 1 |

4.1. Алгоритмы коррекции ошибок

Исправлять ошибки труднее, чем их детектировать или предотвращать. Процедура коррекции ошибок предполагает два совмещеных процесса: обнаружение ошибки и определение места (идентификации сообщения и позиции в сообщении). После решения этих двух задач исправление тривиально — надо инвертировать значение ошибочного бита. В наземных каналах связи, где вероятность ошибки невелика, обычно используется метод детектирования ошибок и повторной пересылки фрагмента, содержащего дефект. Для спутниковых каналов с типичными для них большими задержками системы коррекции ошибок становятся привлекательными. Здесь используют коды Хэмминга или коды свертки.

Код Хэмминга представляет собой блочный код, который позволяет выявить и исправить ошибочно переданный бит в пределах переданного блока. Обычно код Хэмминга характеризуется двумя целыми числами, например, (11,7), используемыми при передаче 7-битных ASCII-кодов. Такая запись говорит, что при передаче 7-битного кода используется 4 контрольных бита (7 + 4 = 11). При этом предполагается, что имела место ошибка в одном бите и что ошибка в двух или более битах существенно менее вероятна. С учетом этого исправление ошибки осуществляется с определенной вероятностью. Например, пусть возможны следующие правильные коды (все они, кроме первого и последнего, отстоят друг от друга на расстояние Хэмминга 4):

00000000

11110000

00001111

11111111

При получении кода 00000111 нетрудно предположить, что правильное значение полученного кода равно 00001111. Другие коды отстоят от полученного на большее расстояние Хэмминга.

Рассмотрим пример передачи кода буквы s = 0x073 = 1110011 с использованием кода Хэмминга (11,7). Таблица 4.2.

| Позиция бита | 11 | 10 | 9 | 8 | 7 | 6 | 5 | 4 | 3 | 2 | 1 |

|---|---|---|---|---|---|---|---|---|---|---|---|

| Значение бита | 1 | 1 | 1 | * | 0 | 0 | 1 | * | 1 | * | * |

Символами * помечены четыре позиции, где должны размещаться контрольные биты. Эти позиции определяются целой степенью 2 (1, 2, 4, 8 и т.д.). Контрольная сумма формируется путем выполнения операции XoR (исключающее ИЛИ) над кодами позиций ненулевых битов. В данном случае это 11, 10, 9, 5 и 3. Вычислим контрольную сумму:

| 11= | 1011 |

| 10= | 1010 |

| 09= | 1001 |

| 05= | 0101 |

| 03= | 0011 |

|

1110 |

Таким образом, приемник получит код

| Позиция бита | 11 | 10 | 9 | 8 | 7 | 6 | 5 | 4 | 3 | 2 | 1 |

|---|---|---|---|---|---|---|---|---|---|---|---|

| Значение бита | 1 | 1 | 1 | 1 | 0 | 0 | 1 | 1 | 1 | 1 | 0 |

Просуммируем снова коды позиций ненулевых битов и получим нуль;

| 11= | 1011 |

| 10= | 1010 |

| 09= | 1001 |

| 08= | 1000 |

| 05= | 0101 |

| 04= | 0100 |

| 03= | 0011 |

| 02= | 0010 |

|

0000 |

Ну а теперь рассмотрим два случая ошибок в одном из битов посылки, например в бите 7 (1 вместо 0) и в бите 5 (0 вместо 1). Просуммируем коды позиций ненулевых битов еще раз:

|

|

В обоих случаях контрольная сумма равна позиции бита, переданного с ошибкой. Теперь для исправления ошибки достаточно инвертировать бит, номер которого указан в контрольной сумме. Понятно, что если ошибка произойдет при передаче более чем одного бита, код Хэмминга при данной избыточности окажется бесполезен.

В общем случае код имеет N = M + C бит и предполагается, что не более чем один бит в коде может иметь ошибку. Тогда возможно N+1 состояние кода (правильное состояние и n ошибочных). Пусть М = 4, а N = 7, тогда слово-сообщение будет иметь вид: M4, M3, M2, C3, M1, C2, C1. Теперь попытаемся вычислить значения С1, С2, С3. Для этого используются уравнения, где все операции представляют собой сложение по модулю 2:

С1 = М1 + М2 + М4 С2 = М1 + М3 + М4 С3 = М2 + М3 + М4

Для определения того, доставлено ли сообщение без ошибок, вычисляем следующие выражения (сложение по модулю 2):

С11 = С1 + М4 + М2 + М1 С12 = С2 + М4 + М3 + М1 С13 = С3 + М4 + М3 + М2

Результат вычисления интерпретируется следующим образом:

| C11 | C12 | C13 | Значение |

|---|---|---|---|

| 1 | 2 | 4 | Позиция бит |

| 0 | 0 | 0 | Ошибок нет |

| 0 | 0 | 1 | Бит С3 неверен |

| 0 | 1 | 0 | Бит С2 неверен |

| 0 | 1 | 1 | Бит M3 неверен |

| 1 | 0 | 0 | Бит С1 неверен |

| 1 | 0 | 1 | Бит M2 неверен |

| 1 | 1 | 0 | Бит M1 неверен |

| 1 | 1 | 1 | Бит M4 неверен |

Описанная схема легко переносится на любое число n и М.

Число возможных кодовых комбинаций М помехоустойчивого кода делится на n классов, где N — число разрешенных кодов. Разделение на классы осуществляется так, чтобы в каждый класс вошел один разрешенный код и ближайшие к нему (по расстоянию Хэмминга ) запрещенные коды. В процессе приема данных определяется, к какому классу принадлежит пришедший код. Если код принят с ошибкой, он заменяется ближайшим разрешенным кодом. При этом предполагается, что кратность ошибки не более qm.

В теории кодирования существуют следующие оценки максимального числа N n -разрядных кодов с расстоянием D.

| d=1 | n=2n |

| d=2 | n=2n-1 |

| d=3 | N 2n/(1 + n) |

| d = 2q + 1 | (для кода Хэмминга это неравенство превращается в равенство) |

В случае кода Хэмминга первые k разрядов используются в качестве информационных, причем

K = n – log(n + 1), откуда следует (логарифм по основанию 2), что k может принимать значения 0, 1, 4, 11, 26, 57 и т.д., это и определяет соответствующие коды Хэмминга (3,1); (7,4); (15,11); (31,26); (63,57) и т.д.

Обобщением кодов Хэмминга являются циклические коды BCH (Bose-Chadhuri-hocquenghem). Эти коды имеют широкий выбор длин и возможностей исправления ошибок.

Одной из старейших схем коррекции ошибок является двух-и трехмерная позиционная схема (

рис.

4.2). Для каждого байта вычисляется бит четности (бит <Ч>, направление Х). Для каждого столбца также вычисляется бит четности (направление Y. Производится вычисление битов четности для комбинаций битов с координатами (X,Y) (направление Z, слои с 1 до N ). Если при транспортировке будет искажен один бит, он может быть найден и исправлен по неверным битам четности X и Y. Если же произошло две ошибки в одной из плоскостей, битов четности данной плоскости недостаточно. Здесь поможет плоскость битов четности N+1.

Таким образом, на 512 передаваемых байтов данных пересылается около 200 бит четности.

Рис.

4.2.

Позиционная схема коррекции ошибок